-

通过序参量来研究量子相变是比较传统的做法, 而从机器学习的角度研究相变是一块全新的领域. 本文提出了先采用无监督学习算法中的高斯混合模型对J1-J2反铁磁海森伯自旋链系统的态矢量进行分类, 再使用监督学习算法中的卷积神经网络鉴别无监督学习算法给出的分类点是否是相变点的方法, 并使用交叉验证的方法对学习效果进行验证. 结果表明, 上述机器学习方法可以从基态精确找到J1–J2反铁磁海森伯自旋链系统的一阶相变点、无法找到无穷阶相变点, 从第一激发态不仅能找到一阶相变点, 还能找到无穷阶相变点.

-

关键词:

- 海森伯J1-J2模型 /

- 机器学习 /

- 神经网络 /

- 相变

Studying quantum phase transitions through order parameters is a traditional method, but studying phase transitions by machine learning is a brand new field. The ability of machine learning to classify, identify, or interpret massive data sets may provide physicists with similar analyses of the exponentially large data sets embodied in the Hilbert space of quantum many-body system. In this work, we propose a method of using unsupervised learning algorithm of the Gaussian mixture model to classify the state vectors of the J1-J2 antiferromagnetic Heisenberg spin chain system, then the supervised learning algorithm of the convolutional neural network is used to identify the classification point given by the unsupervised learning algorithm, and the cross-validation method is adopted to verify the learning effect. Using this method, we study the J1-J2 Heisenberg spin chain system with chain length N = 8, 10, 12, 16 and obtain the same conclusion. The first order phase transition point of J1-J2 antiferromagnetic Heisenberg spin chain system can be accurately found from the ground state vector, but the infinite order phase transition point cannot be found from the ground state vector. The first order and the infinite order phase transition point can be found from the first excited state vector, which indirectly shows that the first excited state may contain more information than the ground state of J1-J2 antiferromagnetic Heisenberg spin chain system. The visualization of the state vector shows the reliability of the machine learning algorithm, which can extract the feature information from the state vector. The result reveals that the machine learning techniques can directly find some possible phase transition points from a large set of state vectorwithout prior knowledge of the energy or locality conditions of the Hamiltonian, which may assists us in studying unknown systems. Supervised learning can verify the phase transition points given by unsupervised learning, thereby indicating that we can discover some useful information about unknown systems only through machine learning techniques. Machine learning techniques can be a basic research tool in strong quantum-correlated systems, and it can be adapted to more complex systems, which can help us dig up hidden information.-

Keywords:

- Heisenberg J1-J2 model /

- machine learning /

- neural network /

- phase transition

[1] Lei W 2016 Phys. Rev. B. 94 195105

Google Scholar

Google Scholar

[2] Wetzel S J 2017 Phys. Rev. E 96 022140

Google Scholar

Google Scholar

[3] Huang L, Wang L 2017 Phys. Rev. B 95 035105

Google Scholar

Google Scholar

[4] Phiala E S, Daniel T, William D 2018 Phys. Rev. D 97 094506

Google Scholar

Google Scholar

[5] LakovlevI A, SotnikovO M, MazurenkoV V 2018 Phys. Rev. B 98 174411

Google Scholar

Google Scholar

[6] Dong X Y, Pollmann F, Zhang X F 2019 Phys. Rev. B 99 121104

Google Scholar

Google Scholar

[7] Tan D R, Jiang F J 2020 Phys. Rev. B 102 224434

Google Scholar

Google Scholar

[8] Tan D R, Li C D, Zhu W P, Jiang F J 2020 New J. Phys. 22 063016

Google Scholar

Google Scholar

[9] Maskara N, Buchhold M, Endres M 2021 arXiv: 2103.15855 [quant-ph]

[10] Tanja D 2021 arXiv: 2103.07236[quant-ph]

[11] Sondhi S L, Girvin S M, Carini J P, Shahar D 1997 Rev. Mod. Phys 69 315

Google Scholar

Google Scholar

[12] Bulla R, Vojta M 2003 Rep. Prog. Phys. 66 2069

Google Scholar

Google Scholar

[13] Walker N, Tam K M, Novak B, Jarrell M 2018 Phys. Rev. E. 98 053305

Google Scholar

Google Scholar

[14] Jadrich R B, Lindquist B A, Pineros W D, Truskeet T M 2018 J. Chem. Phys. 149 194109

Google Scholar

Google Scholar

[15] Canabarro A, Fanchini F F, Malvezzi A L, Pereira R, Chaves R 2019 Phys. Rev. B 100 045129

Google Scholar

Google Scholar

[16] Carrasquilla J, Melko R G 2017 Nat. Phys. 13 431

Google Scholar

Google Scholar

[17] Ahmadreza A, Michel P 2020 arXiv: 2007.09764 [cond-mat. stat-mech]

[18] Chitra R, Pati S, Krishnamurthy H R, Sen D, Ramasesha S 1995 Phys. Rev. B 52 6581

Google Scholar

Google Scholar

[19] Castilla G, Chakravarty S, Emery V J 1995 Phys. Rev. L 75 1823

Google Scholar

Google Scholar

[20] Shu C, Li W, Shi J G, Wang Y P 2007 Phys. Rev. E 76 061108

Google Scholar

Google Scholar

[21] Qian X F, Shi T, Li Y, Song Z, Sun C P 2005 Phys. Rev. A 72 012333

Google Scholar

Google Scholar

[22] 周志华 2016 机器学习 (北京: 清华大学出版社) 第206页

Zhou Z H 2016 Machine Learning (Beijing: Tsinghua University Press) p206 (in Chinese)

[23] 李航 2012 统计机器学习 (北京: 清华大学出版社) 第162页

Li H 2012The Elements of Statistical Learning (Beijing: Tsinghua University Press) p162 (in Chinese)

[24] 徐启伟, 王佩佩, 曾镇佳, 黄泽斌, 周新星, 刘俊敏, 李瑛, 陈书青, 范滇元 2020 物理学报 69 014209

Google Scholar

Google Scholar

Xu Q W, Wang P P, Zeng Z J, Huang Z B, Zhou X X, Liu J M, Li Y, Chen S Q, Fan D Y 2020 Acta Phys. Sin. 69 014209

Google Scholar

Google Scholar

[25] 伊恩·古德费洛, 约书亚·本吉奥, 亚伦·库维尔 著 (赵申剑, 黎彧君, 符天凡, 李凯 译) 2017 深度学习 (北京:人民邮电出版社) 第143—317页

Goodfellow L, Bengio Y, Courville A(translated by Zhang SJ, Li Y J, Fu T F, Li K)2017 Deep Learning (Beijing: The People's Posts and Telecommunications Press) pp143–317 (in Chinese)

-

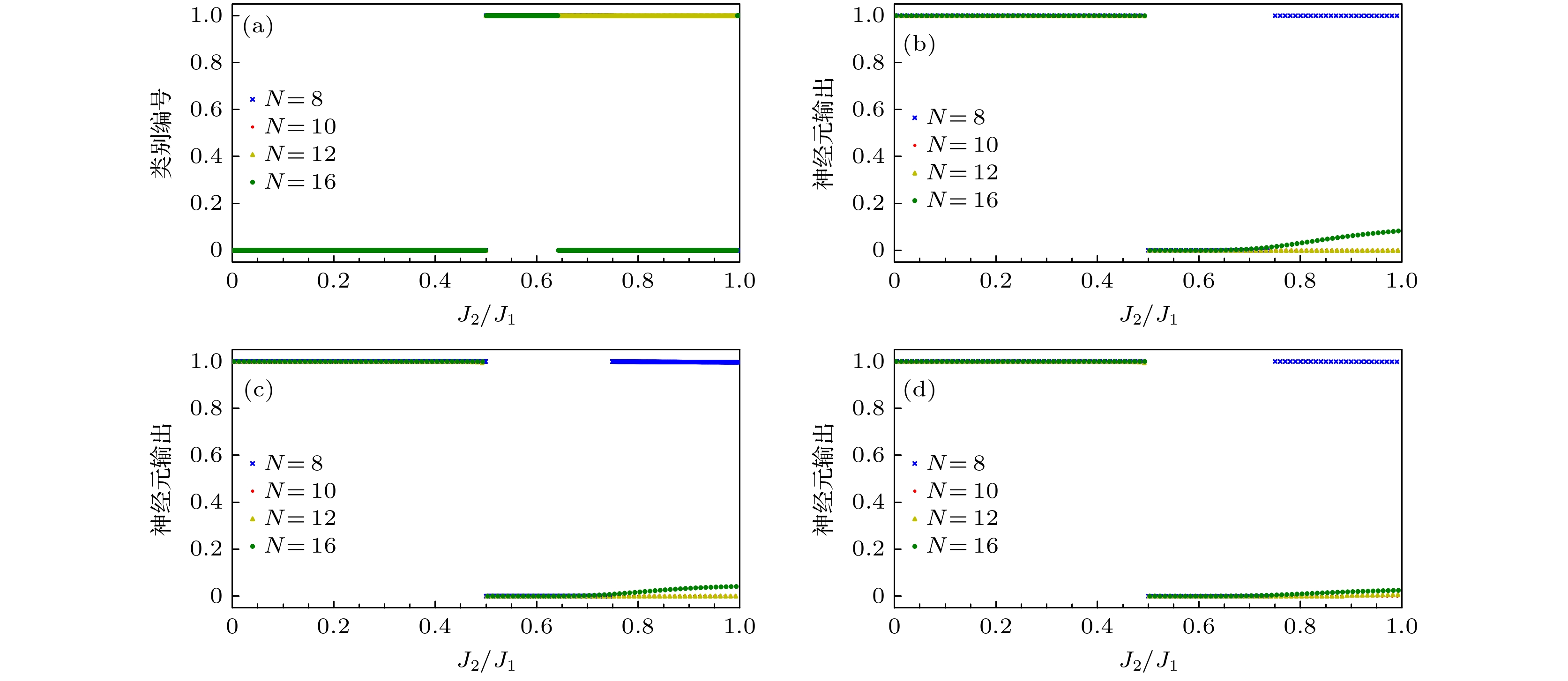

图 2 (a) 训练数据为J2/J1

$\in $ [0, 1)的海森伯J1-J2模型基态矢量生成的GMM对基态矢量的分类结果; (b)采用标记为0的J2/J1$\in $ [0.35, 0.45)和为1的J2/J1$\in $ [0.55, 0.65); (c)标记为0的J2/J1$\in $ [0.3, 0.4)和为1的J2/J1$\in $ [0.55, 0.65); (d)标记为0的J2/J1$\in $ [0.2, 0.3)和为1的J2/J1$\in $ [0.55, 0.65)的基态态矢量作为训练数据, 训练所得的CNN模型对基态态矢量的预测结果Fig. 2. (a) Ground state vector classification results of the GMM generated by the Heisenberg J1-J2 model ground state vector with the training data of J2/J1

$\in $ [0, 1); (b) using the ground state vector of J2/J1$\in $ [0.35, 0.45) marked as 0 and J2/J1$\in $ [0.55, 0.65) marked as 1; (c) J2/J1$\in $ [0.3, 0.4) marked as 0 and J2/J1$\in $ [0.55, 0.65) marked as 1; (d) J2/J1$\in $ [0.2, 0.3) marked as 0 and J2/J1$\in $ [0.55, 0.65) marked as 1 as training data, the prediction results of the ground state vector by the trained convolutional neural network model.图 3 (a) 训练数据为J2/J1

$\in $ [0, 0.5)的海森伯J1-J2模型基态态矢量生成的GMM对基态态矢量的分类结果; (b) 分别为采用标记为0的J2/J1$\in $ [0.25, 0.3)和为1的J2/J1$\in $ [0.35, 0.4); (c)标记为0的J2/J1$\in $ [0.2, 0.25)和为1的J2/J1$\in $ [0.35, 0.4); (d)标记为0的J2/J1$\in $ [0.2, 0.25)和为1的J2/J1$\in $ [0.35, 0.4)(标记为1的数据是标记为0的5倍)的基态态矢量作为训练数据, 训练所得的CNN模型对基态态矢量的预测结果Fig. 3. (a) Ground state vector classification results of the GMM generated by the Heisenberg

J1-J2 model ground state vector with the training data of J2/J1 $\in $ [0, 0.5); (b) respectively usingthe ground state vector of J2/J1$\in $ [0.25, 0.3) marked as 0 and J2/J1$\in $ [0.35, 0.4) marked as 1; (c) J2/J1$\in $ [0.2, 0.25) marked as 0 and J2/J1$\in $ [0.35, 0.4) marked as 1; (d) J2/J1$\in $ [0.2, 0.25) marked as 0 and J2/J1$\in $ [0.35, 0.4) marked as 1 (the data marked as 1 is 5 times as much as the data marked as 0)as training data, the prediction results of the ground state vector by the trained convolutional neural network model.图 4 (a) 训练数据为J2/J1

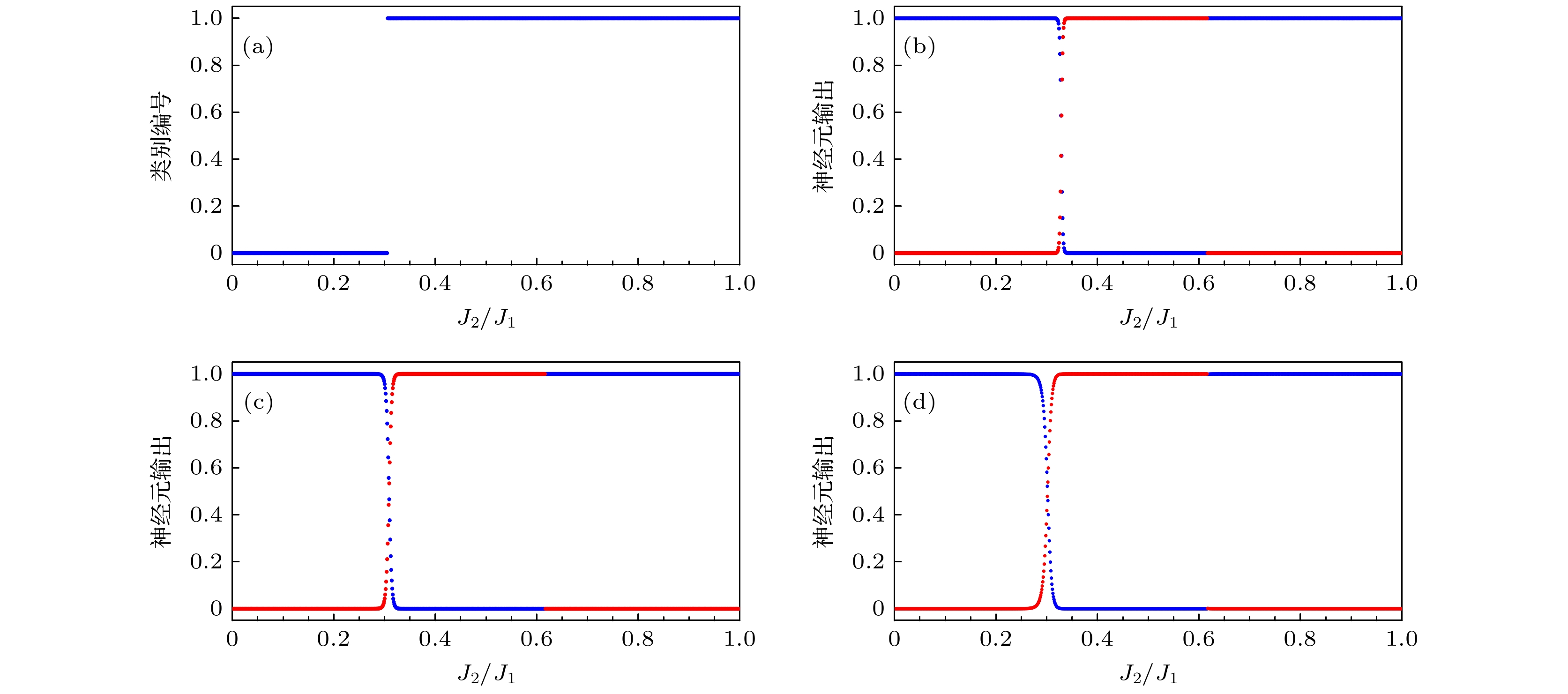

$\in $ [0, 1)的海森伯J1-J2模型第一激发态态矢量生成的GMM对第一激发态态矢量的分类结果; (b)分别为采用标记为0的J2/J1$\in $ [0.35, 0.45)和为1的J2/J1$\in $ [0.55, 0.65); (c)标记为0的J2/J1$\in $ [0.3, 0.4)和为1的J2/J1$\in $ [0.55, 0.65); (d)标记为0的J2/J1$\in $ [0.35, 0.45)和为1的J2/J1$\in $ [0.55, 0.65) (标记为1的数据是标记为0的5倍)的第一激发态态矢量作为训练数据, 训练所得的CNN模型对第一激发态态矢量的预测结果Fig. 4. (a) The first excited state vector classification results of the GMM generated by the Heisenberg J1-J2 model first excited state vector with the training data of J2/J1

$\in $ [0, 1); (b) using the first excited state vector of J2/J1$\in $ [0.35, 0.45) marked as 0 and J2/J1$\in $ [0.55, 0.65) marked as 1; (c) J2/J1$\in $ [0.3, 0.4) marked as 0 and J2/J1$\in $ [0.55, 0.65) marked as 1; (d) J2/J1$\in $ [0.35, 0.45) marked as 0 and J2/J1$\in $ [0.55, 0.65) marked as 1 (the data marked as 1 is 5 times as much as the data marked as 0)as training data, the prediction results of the first excited state vector by the trained convolutional neural network model.图 5 (a)采用标记为0的J2/J1

$\in $ [0.1, 0.2), 标记为1的J2/J1$\in $ [0.3, 0.4); (b)标记为0的J2/J1$\in $ [0, 0.1), 标记为1的J2/J1$\in $ [0.3, 0.4)的第一激发态态矢量作为训练数据, 训练所得的CNN模型对第一激发态态矢量的预测结果Fig. 5. (a) Using the first excited state vector of J2/J1

$\in $ [0.1, 0.2) marked as 0 and J2/J1$\in $ [0.3, 0.4) marked as 1; (b)J2/J1$\in $ [0, 0.1) marked as 0 and J2/J1$\in $ [0.3, 0.4) marked as 1 as training data, the prediction results of the first excited state vector by the trained convolutional neural network model.图 6 (a) 训练数据为J2/J1

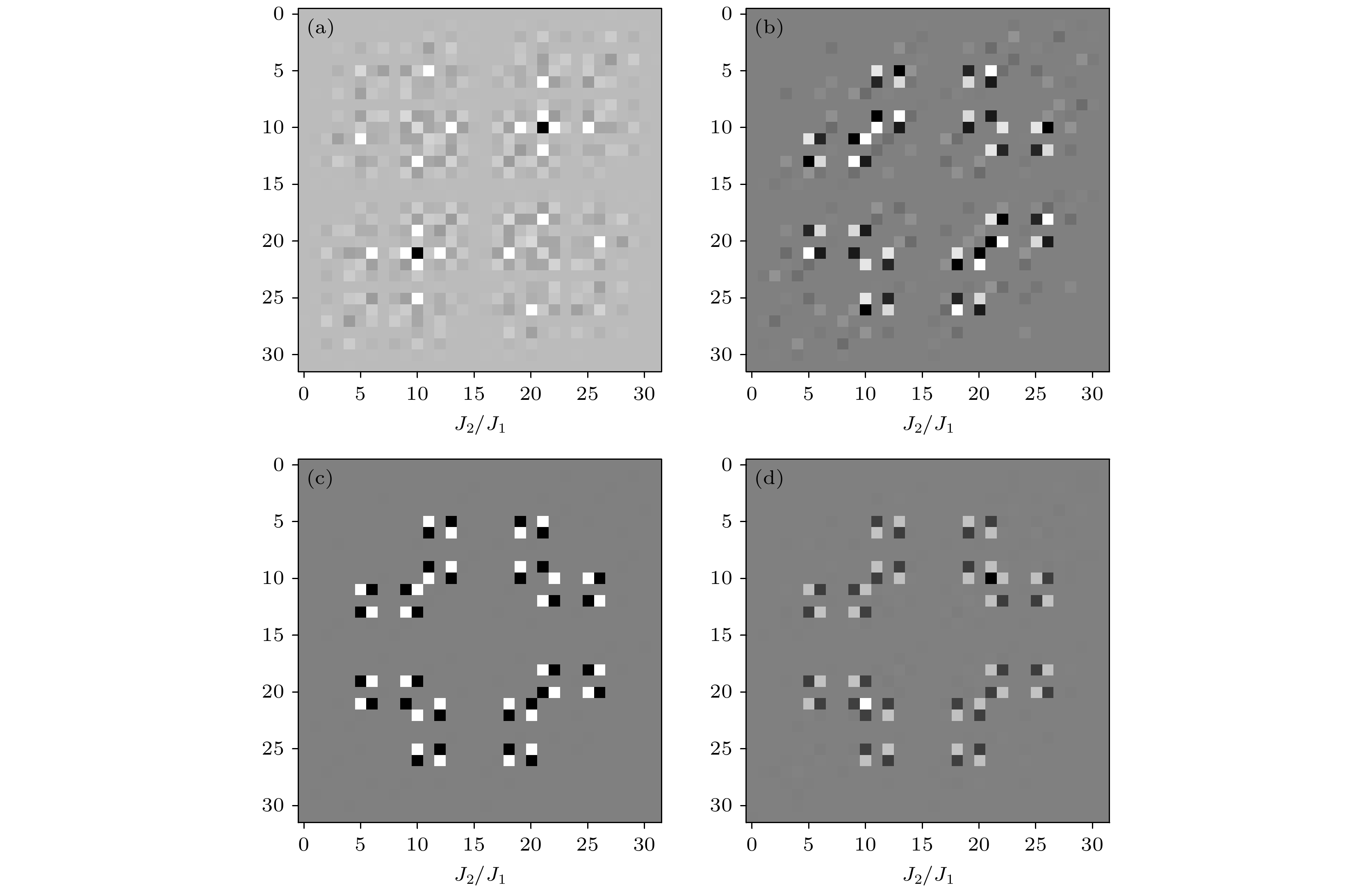

$\in $ [0, 0.24)的海森伯J1-J2模型第一激发态态矢量生成的GMM对第一激发态态矢量的分类结果; (b), (c)分别为采用标记为0的J2/J1$\in $ [0.05, 0.1)和为1的J2/J1$\in $ [0.15, 0.2); 标记为0的J2/J1$\in $ [0, 0.05)和为1的J2/J1$\in $ [0.15, 0.2)的第一激发态态矢量作为训练数据, 训练所得的CNN模型对第一激发态态矢量的预测结果; (d) 训练数据为J2/J1$\in $ [0.25, 0.5)的海森伯J1-J2模型第一激发态态矢量生成的GMM对第一激发态态矢量的分类结果Fig. 6. (a) The first excited state vector classification results of the GMM generated by the Heisenberg J1-J2 model first excited state vector with the training data of J2/J1

$\in $ [0, 0.24); (b) (c) respectively using the first excited state vector of J2/J1$\in $ [0.05, 0.1) marked as 0 and J2/J1$\in $ [0.15, 0.2) marked as 1; J2/J1$\in $ [0, 0.05) marked as 0 and J2/J1$\in $ [0.15, 0.2) marked as 1 as training data, the prediction results of the first excited state vector by the trained convolutional neural network model; (d) he first excited state vector classification results of the GMM generated by the Heisenberg J1-J2 model first excited state vector with the training data of J2/J1$\in $ [0.25, 0.5). -

[1] Lei W 2016 Phys. Rev. B. 94 195105

Google Scholar

Google Scholar

[2] Wetzel S J 2017 Phys. Rev. E 96 022140

Google Scholar

Google Scholar

[3] Huang L, Wang L 2017 Phys. Rev. B 95 035105

Google Scholar

Google Scholar

[4] Phiala E S, Daniel T, William D 2018 Phys. Rev. D 97 094506

Google Scholar

Google Scholar

[5] LakovlevI A, SotnikovO M, MazurenkoV V 2018 Phys. Rev. B 98 174411

Google Scholar

Google Scholar

[6] Dong X Y, Pollmann F, Zhang X F 2019 Phys. Rev. B 99 121104

Google Scholar

Google Scholar

[7] Tan D R, Jiang F J 2020 Phys. Rev. B 102 224434

Google Scholar

Google Scholar

[8] Tan D R, Li C D, Zhu W P, Jiang F J 2020 New J. Phys. 22 063016

Google Scholar

Google Scholar

[9] Maskara N, Buchhold M, Endres M 2021 arXiv: 2103.15855 [quant-ph]

[10] Tanja D 2021 arXiv: 2103.07236[quant-ph]

[11] Sondhi S L, Girvin S M, Carini J P, Shahar D 1997 Rev. Mod. Phys 69 315

Google Scholar

Google Scholar

[12] Bulla R, Vojta M 2003 Rep. Prog. Phys. 66 2069

Google Scholar

Google Scholar

[13] Walker N, Tam K M, Novak B, Jarrell M 2018 Phys. Rev. E. 98 053305

Google Scholar

Google Scholar

[14] Jadrich R B, Lindquist B A, Pineros W D, Truskeet T M 2018 J. Chem. Phys. 149 194109

Google Scholar

Google Scholar

[15] Canabarro A, Fanchini F F, Malvezzi A L, Pereira R, Chaves R 2019 Phys. Rev. B 100 045129

Google Scholar

Google Scholar

[16] Carrasquilla J, Melko R G 2017 Nat. Phys. 13 431

Google Scholar

Google Scholar

[17] Ahmadreza A, Michel P 2020 arXiv: 2007.09764 [cond-mat. stat-mech]

[18] Chitra R, Pati S, Krishnamurthy H R, Sen D, Ramasesha S 1995 Phys. Rev. B 52 6581

Google Scholar

Google Scholar

[19] Castilla G, Chakravarty S, Emery V J 1995 Phys. Rev. L 75 1823

Google Scholar

Google Scholar

[20] Shu C, Li W, Shi J G, Wang Y P 2007 Phys. Rev. E 76 061108

Google Scholar

Google Scholar

[21] Qian X F, Shi T, Li Y, Song Z, Sun C P 2005 Phys. Rev. A 72 012333

Google Scholar

Google Scholar

[22] 周志华 2016 机器学习 (北京: 清华大学出版社) 第206页

Zhou Z H 2016 Machine Learning (Beijing: Tsinghua University Press) p206 (in Chinese)

[23] 李航 2012 统计机器学习 (北京: 清华大学出版社) 第162页

Li H 2012The Elements of Statistical Learning (Beijing: Tsinghua University Press) p162 (in Chinese)

[24] 徐启伟, 王佩佩, 曾镇佳, 黄泽斌, 周新星, 刘俊敏, 李瑛, 陈书青, 范滇元 2020 物理学报 69 014209

Google Scholar

Google Scholar

Xu Q W, Wang P P, Zeng Z J, Huang Z B, Zhou X X, Liu J M, Li Y, Chen S Q, Fan D Y 2020 Acta Phys. Sin. 69 014209

Google Scholar

Google Scholar

[25] 伊恩·古德费洛, 约书亚·本吉奥, 亚伦·库维尔 著 (赵申剑, 黎彧君, 符天凡, 李凯 译) 2017 深度学习 (北京:人民邮电出版社) 第143—317页

Goodfellow L, Bengio Y, Courville A(translated by Zhang SJ, Li Y J, Fu T F, Li K)2017 Deep Learning (Beijing: The People's Posts and Telecommunications Press) pp143–317 (in Chinese)

计量

- 文章访问数: 7800

- PDF下载量: 134

- 被引次数: 0

下载:

下载: