-

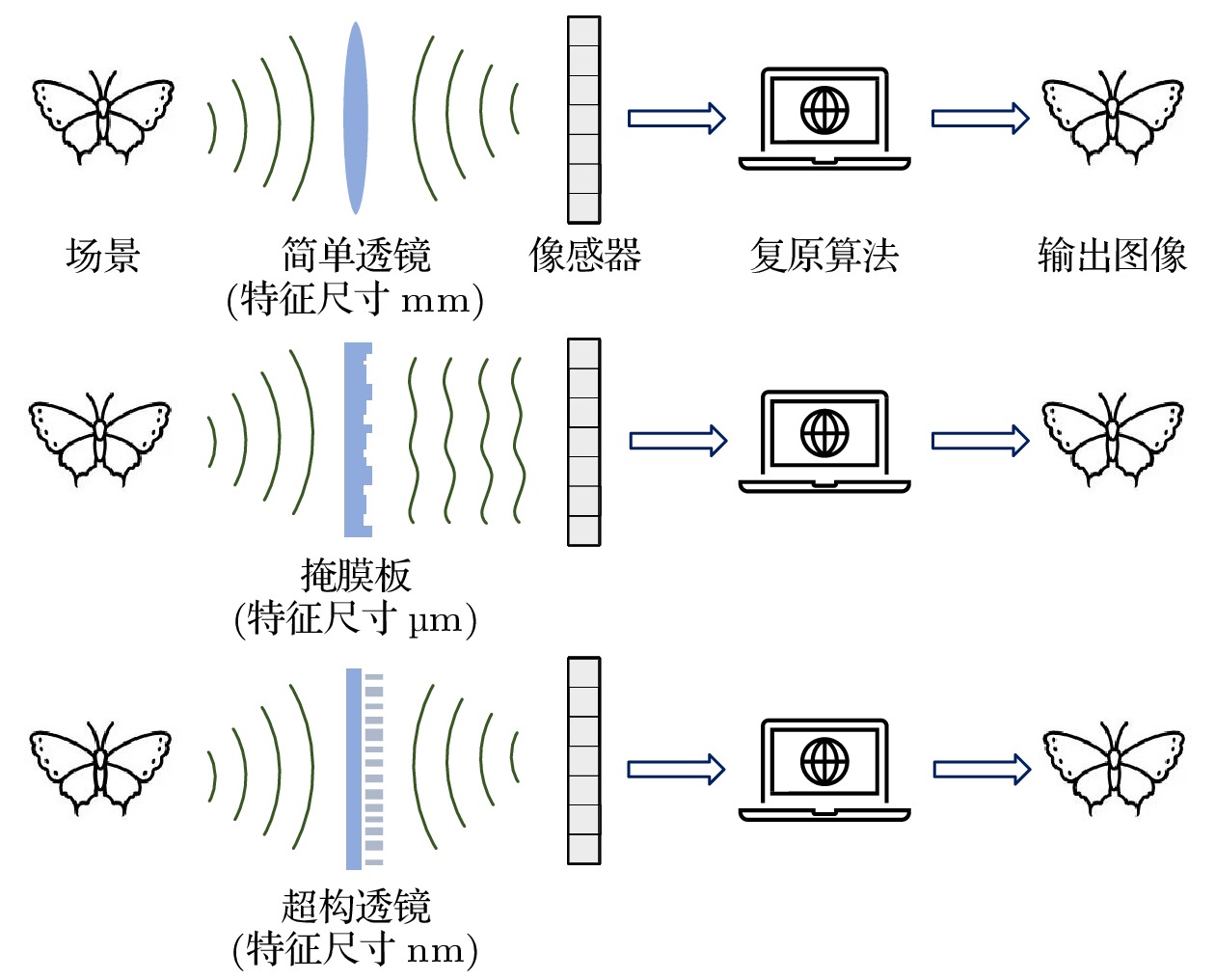

计算成像为光学成像系统提供了更强大的信息获取能力, 通过在成像链路中引入编解码过程, 在增大信息量的同时降低系统的复杂度, 为实现更简单和更智能的成像系统奠定了基础. 本文总结了以计算成像为基础的简单光学成像技术的发展. 简单光学以小型化和集成化的成像元件与系统为目标, 将光学系统设计与图像处理算法进行联合优化, 在小尺寸、低质量和低功耗的系统中实现与复杂光学系统相媲美的成像效果. 随着微纳加工技术的发展, 简单光学元件从单透镜或少片透镜逐渐发展到衍射光学元件、二元光学元件和超构表面等平板光学元件. 复原算法中总结了正向求解算法、基于模型的优化迭代算法和深度学习人工智能算法. 本文介绍了深度成像、高分辨与超分辨成像、大视场和大景深成像等技术, 以及简单光学在消费电子、自动驾驶、机器视觉、安防监控和元宇宙等领域发挥的作用, 并对未来的发展进行展望.Computational imaging enables optical imaging systems to acquire more information with miniaturized setups. Computational imaging can avoid the object-image conjugate limitation of the imaging system, and introduce encoding and decoding processes based on physical optics to achieve more efficient information transmission. It can simultaneously increase the amount of information and reduce the complexity of the system, thereby paving the way for miniaturizing imaging systems. Based on computational imaging, the simple and compact optical imaging techniques are developed, which is also called simple optics. To develop miniaturized optical imaging elements and integrated systems, simple optics utilizes the joint design of optical system and image processing algorithms, thereby realizing high-quality imaging that is comparable to complex optical systems. The imaging systems are of small-size, low-weight, and low-power consumption. With the development of micro-nano manufacturing, the optical elements have evolved from a single lens or a few lenses, to flat/planar optical elements, such as diffractive optical elements and metasurface optical elements. As a result, various lensless and metalens imaging systems have emerged. Owing to the introduction of encoding process and decoding process, an optical imaging model is developed to represent the relationship between the target object and the acquired signal, from which the computational reconstruction is used to restore the image. In the image restoration part, the algorithms are discussed in three categories, i.e. the classic algorithm, the model-based optimization iterative algorithm, and the deep learning (neural network) algorithm. Besides, the end-to-end optimization is highlighted because it introduces a new frame to minimize the complexity of optical system. In this review, the imaging techniques realized by simple optics are also discussed, such as depth imaging, high-resolution and super-resolution imaging, large field of view imaging, and extended depth of field imaging, as well as their important roles in developing consumer electronics, unmanned driving, machine vision, security monitoring, biomedical devices and metaverse. Last but not least, the challenges and future developments are prospected.

-

Keywords:

- simple optics /

- computational imaging /

- lensless /

- metalens

[1] 戴琼海, 索津莉, 季向阳, 曹汛 2016 计算摄像学: 全光视觉信息的计算采集 (北京: 清华大学出版社) 第3—5页

Dai Q H, Suo J L, Ji X Y, Cao X 2016 Computational Photography Computational Capture of Plenoptic Visal Information (Beijing: Tsinghua University Press) pp3–5 (in Chinese)

[2] 薛艳杰, 薛随建, 朱明, 崔辰州 2014 中国科学院院刊 29 368

Xue Y J, Xue S J, Zhu M, Cui C Z 2014 Bull. Chin. Acad. Sci. 29 368

[3] Adkins J https://www.nasa.gov/mission_pages/webb/main/index.html [2023-2-19]

[4] 郭红锋 2022 军事文摘 516 48

Guo H F 2022 Military Digest 516 48

[5] 李焱, 龚旗煌 2015 物理与工程 25 31

Li Y, Gong Q H 2015 Phys. Eng. 25 31

[6] 毛峥乐, 王琛, 程亚 2008 中国激光 35 1283

Google Scholar

Google Scholar

Mao Z L, Wang C, Cheng Y 2008 Chin. J. Lasers 35 1283

Google Scholar

Google Scholar

[7] Kozawa Y, Matsunaga D, Sato S 2018 Optica 5 86

Google Scholar

Google Scholar

[8] 郭乾统, 李博 2021 集成电路应用 9 1

Guo Q T, Li B 2021 Appl. IC 9 1

[9] 杨朝兴 2016 博士学位论文 (上海: 中国科学院上海光学精密机械研究所)

Yang Z X 2016 Ph. D. Dissertation (Shanghai: Shanghai Institute of Optics and Fine Mechanics, the Chinese Academy of Sciences) (in Chinese)

[10] 边丽蘅, 戴琼海 2022 计算成像与感知 (北京: 人民邮电出版社) 第3—5页

Bian L H, Dai Q H 2022 Computational Imaging and Sensing (Beijing: Post & Telecom Press) pp3–5 (in Chinese)

[11] 左超, 陈钱 2022 红外与激光工程 51 20220110

Google Scholar

Google Scholar

Zuo C, Chen Q 2022 Infrared Laser Eng. 51 20220110

Google Scholar

Google Scholar

[12] 杨彦杰 2017 红外 38 8

Yang Y J 2017 Infrared 38 8

[13] Shi F https://www.163.com/dy/article/GNI2FICD0511PT5V.html [2022-12-5]

[14] Wright E https://svs.gsfc.nasa.gov/4720 [2022-12-5]

[15] Doshi S https://seas.harvard.edu/news/2021/03/federico-capasso-help-develop-super-camera [2022-12-5]

[16] Wu J, Guo Y, Deng C, Zhang A, Qiao H, Lu Z, Xie J, Fang L, Dai Q H 2022 Nature 612 62

Google Scholar

Google Scholar

[17] Authier A 2003 Dynamical Theory of X-Ray Diffraction (London: Oxford University Press) pp479-480

[18] 陈宜方 2022 光学学报 42 1134005

Google Scholar

Google Scholar

Chen Y F 2022 Acta Opt. Sin. 42 1134005

Google Scholar

Google Scholar

[19] Chao W, Kim J, Rekawa S, Fischer P, Anderson E H 2009 Opt. Express 17 17669

Google Scholar

Google Scholar

[20] Mohacsi I, Vartiainen I, Rosner B, Guizar-Sicairos M, Guzenko V A, McNulty I, Winarski R, Holt M V, David C 2017 Sci. Rep. 7 43624

Google Scholar

Google Scholar

[21] 孙世峰 2020 物理学报 69 198701

Google Scholar

Google Scholar

Sun S F 2020 Acta Phys. Sin. 69 198701

Google Scholar

Google Scholar

[22] Dicke R 1968 Astrophys. J. 153 L101

Google Scholar

Google Scholar

[23] Ables J 1968 Publ. Astron. Soc. Pac. 1 172

Google Scholar

Google Scholar

[24] Haboub A, MacDowell A A, Marchesini S, Parkinson D Y 2014 Rev. Sci. Instrum. 85 063704

Google Scholar

Google Scholar

[25] Kulow A, Buzanich A G, Reinholz U, Streli C, Radtke M 2020 J. Anal. At. Spectrom. 35 347

Google Scholar

Google Scholar

[26] Glovinski C https://www.metalenz.com/press-release-metalenz-raises-30-million-series-b-led-by-neotribe-ventures-to-address-fast-growing-demand-for-its-breakthrough-metasurface-optics/ [2022-12-5]

[27] Yang X https://36kr.com/p/1673109498994694?channel=wechat [2022-12-6]

[28] Schneider J https://petapixel.com/2021/07/12/samsung-researching-flat-metalens-tech-for-smartphone-integration/ [2022-12-5]

[29] https://www.nsfc.gov.cn/publish/portal0/tab1392/info87786.htm [2022-12-8]

[30] Schuler C J, Hirsch M, Harmeling S, Schölkopf B 2011 International Conference on Computer Vision Barcelona, Spain, November 6–13, 2011 p659

[31] Heide F, Rouf M, Hullin M B, Labitzke B, Heidrich W, Kolb A 2013 ACM Trans. Graph. 32 149

[32] Bian Y X, Jiang Y N, Huang Y R, Yang X F, Deng W J, Shen H, Shen R B, Kuang C F 2021 Opt. Laser Technol. 139 106900

Google Scholar

Google Scholar

[33] Liu Y, Zhang C, Kou T, Li Y, Shen J 2021 Opt. Express 29 28530

Google Scholar

Google Scholar

[34] Li Z, Hou Q, Wang Z, Tan F, Liu J, Zhang W 2021 Opt. Lett. 46 5453

Google Scholar

Google Scholar

[35] Peng Y, Fu Q, Amata H, Su S, Heide F, Heidrich W 2015 Opt. Express 23 31393

Google Scholar

Google Scholar

[36] Wu Y, Boominathan V, Chen H, Sankaranarayanan A, Veeraraghavan A 2019 IEEE International Conference on Computational Photography (ICCP) Tokyo, Japan, May 15–17, 2019 p1

[37] Chang J, Wetzstein G 2019 IEEE/CVF International Conference on Computer Vision (ICCV) Seoul, Korea (South), October 27–November 2, 2019 p10192

[38] Peng Y F, Sun Q L, Dun X, Wetzstein G, Heidrich W, Heide F 2019 ACM Trans. Graph. 38 1

[39] Qi B, Chen W, Dun X, Hao X, Wang R, Liu X, Li H, Peng Y 2022 Appl. Opt. 61 1097

Google Scholar

Google Scholar

[40] 郑云达, 黄玮, 徐明飞, 潘云, 贾树强, 张晓菲, 卢勇男 2019 中国光学 12 1090

Google Scholar

Google Scholar

Zheng Y D, Huang W, Xu M F, Pan Y, Jia S Q, Zhang X F, Lu Y N 2019 Chin. Opt. 12 1090

Google Scholar

Google Scholar

[41] Zhan D Z, Li W L, Yin X Q, Niu C Y, Liu J 2021 IEEE Access 9 49338

Google Scholar

Google Scholar

[42] Sun Q, Wang C, Fu Q, Dun X, Heidrich W 2021 ACM Trans. Graph. 40 1

[43] Tseng E, Mosleh A, Mannan F, St-Arnaud K, Sharma A, Peng Y F, Braun A, Nowrouzezahrai D, Lalonde J F, Heide F 2021 ACM Trans. Graph. 40 18

[44] Ji J R, Xie H B, Yang L 2023 Opt. Commun. 526 128918

Google Scholar

Google Scholar

[45] 程颖 2013 博士学位论文 (天津: 天津大学)

Cheng Y 2013 Ph. D. Dissertation (Tianjin: Tianjin University) (in Chinese)

[46] Beier M, Hartung J, Peschel T, Damm C, Gebhardt A, Scheiding S, Stumpf D, Zeitner U D, Risse S, Eberhardt R, Tunnermann A 2015 Appl. Opt. 54 3530

Google Scholar

Google Scholar

[47] 陈炳旭, 廖志远, 操超, 白瑜, 牟达 2020 红外与激光工程 49 20200005

Google Scholar

Google Scholar

Chen B X, Liao Z Y, Cao C, Bai Y, Mu D 2020 Infrared Laser Eng. 49 20200005

Google Scholar

Google Scholar

[48] Yu J, Wang Y F, Qiu R S, Wang Z S 2022 Infrared Phys. Technol. 123 104207

Google Scholar

Google Scholar

[49] Meng Q, Wang H, Liang W, Yan Z, Wang B 2019 Appl. Opt. 58 609

Google Scholar

Google Scholar

[50] Ni J, Yang T, Cheng D, Wang Y 2021 Appl. Opt. 60 4491

Google Scholar

Google Scholar

[51] Zhang B, Jin G, Zhu J 2021 Light Sci. Appl. 10 65

Google Scholar

Google Scholar

[52] 杨通, 段璎哲, 程德文, 王涌天 2021 光学学报 41 0108001

Google Scholar

Google Scholar

Yang T, Duan Y Z, Cheng D W, Wang Y T 2021 Acta Opt. Sin. 41 0108001

Google Scholar

Google Scholar

[53] 吴佳琛 2022 博士学位论文 (北京: 清华大学)

Wu J C 2022 Ph. D. Dissertation (Beijing: Tsinghua University) (in Chinese)

[54] Lange D, Storment C W, Conley C A, Kovacs G T A 2005 Sens. Actuators B Chem. 107 904

Google Scholar

Google Scholar

[55] Ozcan A, McLeod E 2016 Annu. Rev. Biomed. Eng. 18 77

Google Scholar

Google Scholar

[56] Ozcan A, Demirci U 2008 Lab Chip 8 98

Google Scholar

Google Scholar

[57] Cui X, Lee L M, Heng X, Zhong W, Sternberg P W, Psaltis D, Yang C 2008 Proc. Natl. Acad. Sci. U. S. A. 105 10670

Google Scholar

Google Scholar

[58] Zheng G, Lee S A, Yang S, Yang C 2010 Lab Chip 10 3125

Google Scholar

Google Scholar

[59] Gabor D 1948 Nature 161 777

Google Scholar

Google Scholar

[60] Luo W, Greenbaum A, Zhang Y B, Ozcan A 2015 Light Sci. Appl. 4 e261

Google Scholar

Google Scholar

[61] Kirmani A, Jeelani H, Montazerhodjat V, Goyal V K 2012 IEEE Signal. Process. Lett. 19 31

Google Scholar

Google Scholar

[62] Wu D, Wetzstein G, Barsi C, Willwacher T, Dai Q H, Raskar R 2014 Int. J. Comput. Vis. 110 128

Google Scholar

Google Scholar

[63] Satat G, Tancik M, Raskar R 2017 IEEE Trans. Comput. Imaging 3 398

Google Scholar

Google Scholar

[64] Rego J D, Chen H, Li S, Gu J, Jayasuriya S 2022 Opt. Express 30 27214

Google Scholar

Google Scholar

[65] Barrett H H, Horrigan F A 1973 Appl. Opt. 12 2686

Google Scholar

Google Scholar

[66] Anand V, Katkus T, Linklater D P, Ivanova E P, Juodkazis S 2020 J. Imaging 6 99

[67] Fenimore E E, Cannon T M 1978 Appl. Opt. 17 337

Google Scholar

Google Scholar

[68] Gottesman S R, Fenimore E E 1989 Appl. Opt. 28 4344

Google Scholar

Google Scholar

[69] DeWeert M J, Farm B P 2015 Opt. Eng. 54 023102

Google Scholar

Google Scholar

[70] Asif M S, Ayremlou A, Sankaranarayanan A, Veeraraghavan A, Baraniuk R G 2017 IEEE Trans. Comput. Imaging 3 384

Google Scholar

Google Scholar

[71] Adams J K, Boominathan V, Avants B W, Vercosa D G, Ye F, Baraniuk R G, Robinson J T, Veeraraghavan A 2017 Sci. Adv. 3 e1701548

Google Scholar

Google Scholar

[72] Shimano T, Nakamura Y, Tajima K, Sao M, Hoshizawa T 2018 Appl. Opt. 57 2841

Google Scholar

Google Scholar

[73] Tajima K, Shimano T, Nakamura Y, Sao M, Hoshizawa T 2017 IEEE International Conference on Computational Photography (ICCP) Stanford Univ, Stanford, CA, May. 12-14, 2017 p1

[74] Wu J, Zhang H, Zhang W, Jin G, Cao L, Barbastathis G 2020 Light Sci. Appl. 9 53

[75] Zhang L, Zhan H, Liu X, Xing F, You Z 2022 Microsyst. Nanoeng. 8 83

Google Scholar

Google Scholar

[76] Stork D G, Gill P R 2013 The Seventh International Conference on Sensor Technologies and Applications Barcelona, Spain, Auguest 25–31, 2013 p186

[77] Stork D G, Gill P R 2014 Int. J. Adv. Syst. Meas. 7 201

[78] Antipa N, Kuo G, Heckel R, Mildenhall B, Bostan E, Ng R, Waller L 2018 Optica 5 1

Google Scholar

Google Scholar

[79] Monakhova K, Yanny K, Aggarwal N, Waller L 2020 Optica 7 1298

Google Scholar

Google Scholar

[80] Peng Y F, Fu Q, Heide F, Heidrich W 2016 ACM Trans. Graph. 35 31

[81] 赵玺竣, 范斌, 何一苇, 张豪, 郑书培, 钟烁, 雷嘉明, 杨伟, 杨虎 2022 光学学报 42 1305001

Google Scholar

Google Scholar

Zhao X J, Fan B, He Y W, Zhang H, Zheng S P, Zhong S, Lei J M, Yang W, Yang H 2022 Acta Opt. Sin. 42 1305001

Google Scholar

Google Scholar

[82] Boominathan V, Adams J K, Robinson J T, Veeraraghavan A 2020 IEEE Trans. Pattern Anal. Mach. Intell. 42 1618

Google Scholar

Google Scholar

[83] Dun X, Ikoma H, Wetzstein G, Wang Z S, Cheng X B, Peng Y F 2020 Optica 7 913

Google Scholar

Google Scholar

[84] Dun X, Wang Z S, Peng Y F 2019 SPIE/COS Photonics Asia Hangzhou, China, October 20–23, 2020 p111870 I

[85] Baek S-H, Ikoma H, Jeon D S, Li Y Q, Heidrich W, Wetzstein G, Kim M H 2021 IEEE/CVF International Conference on Computer Vision (ICCV) Montreal, QC, Canada, October 10–17, 2021 p2631

[86] Heide F, Fu Q, Peng Y, Heidrich W 2016 Sci. Rep. 6 33543

Google Scholar

Google Scholar

[87] Banerji S, Meem M, Majumder A, Dvonch C, Sensale-Rodriguez B, Menon R 2019 Osa Continuum 2 2968

Google Scholar

Google Scholar

[88] Chen W T, Zhu A D Y, Capasso F 2020 Nat. Rev. Mater. 5 604

Google Scholar

Google Scholar

[89] Zou X J, Zheng G G, Yuan Q, Zang W B, Chen R, Li T Y, Li L, Wang S M, Wang Z L, Zhu S N 2020 Photonix 1 2

Google Scholar

Google Scholar

[90] Pan M, Fu Y, Zheng M, Chen H, Zang Y, Duan H, Li Q, Qiu M, Hu Y 2022 Light Sci. Appl. 11 195

Google Scholar

Google Scholar

[91] Decker M, Staude I, Falkner M, Dominguez J, Neshev D N, Brener I, Pertsch T, Kivshar Y S 2015 Adv. Opt. Mater. 3 813

Google Scholar

Google Scholar

[92] Li J, Wu T, Xu W, Liu Y, Liu C, Wang Y, Yu Z, Zhu D, Yu L, Ye H 2019 Opt. Express 27 23186

Google Scholar

Google Scholar

[93] Khorasaninejad M, Capasso F 2015 Nano Lett. 15 6709

Google Scholar

Google Scholar

[94] Khorasaninejad M, Zhu A Y, Roques-Carmes C, Chen W T, Oh J, Mishra I, Devlin R C, Capasso F 2016 Nano Lett. 16 7229

Google Scholar

Google Scholar

[95] 张飞, 蔡吉祥, 蒲明博, 罗先刚 2021 物理 50 300

Google Scholar

Google Scholar

Zhang F, Cai J X, Pu M B, Luo X G 2021 Physics 50 300

Google Scholar

Google Scholar

[96] Khorasaninejad M, Chen W T, Devlin R C, Oh J, Zhu A Y, Capasso F 2016 Science 352 1190

Google Scholar

Google Scholar

[97] Wang S, Wu P C, Su V C, Lai Y C, Hung Chu C, Chen J W, Lu S H, Chen J, Xu B, Kuan C H, Li T, Zhu S, Tsai D P 2017 Nat. Commun. 8 187

Google Scholar

Google Scholar

[98] Berry M V 1984 Proc. R. Soc. Lond. A 392 45

[99] Pancharatnam S 2013 Resonance 18 387

Google Scholar

Google Scholar

[100] Chen C, Ye X, Sun J, Chen Y, Huang C, Xiao X, Song W, Zhu S, Li T 2022 Optica 9 1314

Google Scholar

Google Scholar

[101] Tseng E, Colburn S, Whitehead J, Huang L, Baek S H, Majumdar A, Heide F 2021 Nat. Commun. 12 6493

Google Scholar

Google Scholar

[102] Zhang F, Pu M, Li X, Ma X, Guo Y, Gao P, Yu H, Gu M, Luo X 2021 Adv. Mater. 33 e2008157

Google Scholar

Google Scholar

[103] Zhang Y X, Pu M B, Jin J J, Lu X J, Guo Y H, Cai J X, Zhang F, Ha Y L, He Q, Xu M F, Li X, Ma X L, Luo X G 2022 Opto-Electron. Adv. 5 220058

Google Scholar

Google Scholar

[104] She A, Zhang S, Shian S, Clarke D R, Capasso F 2018 Opt. Express 26 1573

Google Scholar

Google Scholar

[105] Liu X, Chen M K, Chu C H, Zhang J, Leng B, Yamaguchi T, Tanaka T, Tsai D P 2023 ACS Photonics 2 c01667

[106] Zhao F, Shen Z C, Wang D C, Xu B J, Chen X N, Yang Y M 2021 Photonics Res. 9 2388

Google Scholar

Google Scholar

[107] Hou M M, Chen Y, Yi F 2022 Conference on Lasers and Electro-Optics (CLEO) San Jose, CA, USA, May 15-20, 2022 p1

[108] Chen J, Ye X, Gao S L, Chen Y X, Zhao Y W, Huang C Y, Qiu K, Zhu S N, Li T 2022 Optica 9 431

Google Scholar

Google Scholar

[109] Xu B B, Li H M, Gao S L, Hua X, Yang C, Chen C, Yan F, Zhu S N, Li T 2020 Adv. Photonics 2 066004

[110] Tseng E, Colburn S, Whitehead J, Huang L, Baek S H, Majumdar A, Heide F https://light.princeton.edu/publication/neural-nano-optics/ [2022-12-12]

[111] Colburn S, Zhan A, Majumdar A 2018 Sci. Adv. 4 eaar2114

Google Scholar

Google Scholar

[112] Lei Y S, Guo Y H, Pu M B, He Q, Gao P, Li X, Ma X L, Luo X G 2022 Phys. Status. Solidi-Rapid Res. Lett. 16 2100469

Google Scholar

Google Scholar

[113] Anand V, Han M, Maksimovic J, Ng S H, Katkus T, Klein A, Bambery K, Tobin M J, Vongsvivut J, Juodkazis S 2022 Opto-Electron. Sci. 1 210006

Google Scholar

Google Scholar

[114] 赵丽萍, 邬敏贤, 金国藩, 严瑛白 1998 光学学报 18 621

Google Scholar

Google Scholar

Zhao L P, Wu M X, Jin G F, Yan Y B 1998 Acta Opt. Sin. 18 621

Google Scholar

Google Scholar

[115] Boominathan V, Robinson J T, Waller L, Veeraraghavan A 2022 Optica 9 1

Google Scholar

Google Scholar

[116] 李雄, 马晓亮, 罗先刚 2017 光电工程 44 255

Google Scholar

Google Scholar

Li X, Ma X L, Luo X G 2017 Opto-Electron. Rev. 44 255

Google Scholar

Google Scholar

[117] 许可, 王星儿, 范旭浩, 刘耘呈, 余轩, 高辉, 熊伟 2022 光电工程 49 220183

Google Scholar

Google Scholar

Xu K, Wang X E, Fan X H, Liu Y C, Yu X, Gao H, Xiong W 2022 Opto-electron. Rev. 49 220183

Google Scholar

Google Scholar

[118] 蔡利梅 2020MATLAB图像处理: 理论、算法与实例分析 (北京: 清华大学出版社) 第274—298页

Cai L M 2022 MATLAB Image Processing Theory Algorithm and Case Analysis (Beijing: Tsinghua University Press) pp274–298 (in Chinese)

[119] 张华 2020 博士学位论文 (北京: 清华大学)

Zhang H 2020 Ph. D. Dissertation (Beijing: Tsinghua University) (in Chinese)

[120] Farsiu S, Robinson M D, Elad M, Milanfar P 2004 IEEE Trans. Image. Process. 13 1327

Google Scholar

Google Scholar

[121] Bredies K, Kunisch K, Pock T 2010 SIAM J. Imaging Sci. 3 492

Google Scholar

Google Scholar

[122] Daubechies I, Defrise M, De Mol C 2004 Commun. Pure Appl. Math. 57 1413

Google Scholar

Google Scholar

[123] Bioucas-Dias J M, Figueiredo M A 2007 IEEE Trans. Image. Process. 16 2992

Google Scholar

Google Scholar

[124] Beck A, Teboulle M 2009 SIAM J. Imaging Sci. 2 183

Google Scholar

Google Scholar

[125] Boyd S, Parikh N, Chu E, Peleato B, Eckstein J 2011 Found. Trends Mach. Learn. 3 1

Google Scholar

Google Scholar

[126] Wu J C, Cao L C 2022 Acta Photon. Sin. 51 0751412

Google Scholar

Google Scholar

[127] Choi K, Horisaki R, Hahn J, Lim S, Marks D L, Schulz T J, Brady D J 2010 Appl. Opt. 49 H1

Google Scholar

Google Scholar

[128] Cull C F, Wikner D A, Mait J N, Mattheiss M, Brady D J 2010 Appl. Opt. 49 E67

Google Scholar

Google Scholar

[129] Hahn J, Lim S, Choi K, Horisaki R, Brady D J 2011 Opt. Express 19 7289

Google Scholar

Google Scholar

[130] Hahn J, Lim S, Choi K, Horisaki R, Marks D L, Brady D J 2010 Biomedical Optics and 3-D Imaging Miami Florida, April 11–14, 2010 pJMA1

[131] Zhang H, Cao L C, Jin G F, Brady D 2020 Laser Optoelectron. Prog. 57 080001

[132] Ma C G, Cao X, Tong X, Dai Q H, Lin S 2014 Int. J. Comput. Vis. 110 141

Google Scholar

Google Scholar

[133] Zuo C, Sun J, Zhang J, Hu Y, Chen Q 2015 Opt. Express 23 14314

Google Scholar

Google Scholar

[134] Wang H, Lyu M, Situ G 2018 Opt. Express 26 22603

Google Scholar

Google Scholar

[135] Wang K, Dou J, Kemao Q, Di J, Zhao J 2019 Opt. Lett. 44 4765

Google Scholar

Google Scholar

[136] Ren Z B, Xu Z M, Lam E Y 2019 Adv. Photonics 1 016004

[137] Tahara T, Zhang Y P, Rosen J, Anand V, Cao L C, Wu J C, Koujin T, Matsuda A, Ishii A, Kozawa Y, Okamoto R, Oi R, Nobukawa T, Choi K, Imbe M, Poon T C 2022 Appl. Phys. B Lasers Opt. 128 193

Google Scholar

Google Scholar

[138] Wu Y F, Wu J C, Jin S Z, Cao L C, Jin G F 2021 Opt. Commun. 493 126970

Google Scholar

Google Scholar

[139] Bai C, Zhou M, Min J, Dang S, Yu X, Zhang P, Peng T, Yao B 2019 Opt. Lett. 44 5141

Google Scholar

Google Scholar

[140] Wang F, Bian Y, Wang H, Lyu M, Pedrini G, Osten W, Barbastathis G, Situ G 2020 Light Sci. Appl. 9 77

Google Scholar

Google Scholar

[141] Metzler C, Schniter P, Veeraraghavan A, Baraniuk R 2018 Proceedings of the 35th International Conference on Machine Learning Stockholmsmässan Stockholm, Sweden, July 10–15, 2018 p3501

[142] Li S, Deng M, Lee J, Sinha A, Barbastathis G 2018 Optica 5 803

Google Scholar

Google Scholar

[143] Li Y Z, Xue Y J, Tian L 2018 Optica 5 1181

Google Scholar

Google Scholar

[144] Alom M Z, Taha T M, Yakopcic C, Westberg S, Sidike P, Nasrin M S, Hasan M, Van Essen B C, Awwal A A S, Asari V K 2019 Electronics 8 292

Google Scholar

Google Scholar

[145] Barbastathis G, Ozcan A, Situ G 2019 Optica 6 921

Google Scholar

Google Scholar

[146] He K, Zhang X, Ren S, Sun J 2015 IEEE International Conference on Computer Vision (ICCV) Santiago Chile, December 7–13, 2015 p1026

[147] Lecun Y, Bottou L, Bengio Y, Haffner P 1998 Proc. IEEE 86 2278

Google Scholar

Google Scholar

[148] Lipton Z C, Berkowitz J, Elkan C 2015 arXiv: 1506.00019 [cs. LG]

[149] 王飞, 王昊, 卞耀明, 司徒国海 2020 光学学报 40 0111002

Google Scholar

Google Scholar

Wang F, Wang H, Bian Y M, Situ G H 2020 Acta Opt. Sin. 40 0111002

Google Scholar

Google Scholar

[150] Ronneberger O, Fischer P, Brox T 2015 Medical Image Computing and Computer-Assisted Intervention–MICCAI Munich, Germany, October 5–9, 2015 p234

[151] Khan S S, Adarsh V, Boominathan V, Tan J, Veeraraghavan A, Mitra K 2019 IEEE/CVF International Conference on Computer Vision (ICCV) Seoul, Korea (South), October 27–November 2, 2019 p7859

[152] Wu J, Cao L, Barbastathis G 2021 Opt. Lett. 46 130

Google Scholar

Google Scholar

[153] Haris M, Shakhnarovich G, Ukita N 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Salt Lake City, UT, USA, June 18–23, 2018 p1664

[154] Zhou H, Feng H J, Hu Z X, Xu Z H, Li Q, Chen Y T 2020 Opt. Express 28 30248

Google Scholar

Google Scholar

[155] 李江勇, 吴晓琴, 刘飞, 魏雅喆, 邵晓鹏 2021 光学学报 41 2422004

Google Scholar

Google Scholar

Li J Y, Wu X Q, Liu F, Wei Y Z, Shao X P 2021 Acta Opt. Sin. 41 2422004

Google Scholar

Google Scholar

[156] Sitzmann V, Diamond S, Peng Y F, Dun X, Boyd S, Heidrich W, Heide F, Wetzstein G 2018 ACM Trans. Graph. 37 114

[157] Liu X, Li L, Liu X, Hao X, Peng Y 2022 Opt. Express 30 36973

Google Scholar

Google Scholar

[158] Stork D G, Robinson M D 2008 Appl. Opt. 47 B64

Google Scholar

Google Scholar

[159] Robinson M D, Stork D 2008 Optical Systems Design Glasgow, Scotland, United Kingdom, September 27, 2008 p710011

[160] Chen M K, Liu X, Wu Y, Zhang J, Yuan J, Zhang Z, Tsai D P 2022 Adv. Mater. e2107465

[161] Banerji S, Meem M, Majumder A, Sensale-Rodriguez B, Menon R 2020 Optica 7 214

Google Scholar

Google Scholar

[162] Fan Q, Xu W, Hu X, Zhu W, Yue T, Zhang C, Yan F, Chen L, Lezec H J, Lu Y, Agrawal A, Xu T 2022 Nat. Commun. 13 2130

Google Scholar

Google Scholar

[163] Hu Z Y, Zhang Y L, Pan C, Dou J Y, Li Z Z, Tian Z N, Mao J W, Chen Q D, Sun H B 2022 Nat. Commun. 13 5634

Google Scholar

Google Scholar

[164] Toulouse A, Drozella J, Motzfeld P, Fahrbach N, Aslani V, Thiele S, Giessen H, Herkommer A M 2022 Opt. Express 30 707

Google Scholar

Google Scholar

[165] Baek S H, Gutierrez D, Kim M H 2016 ACM Trans. Graph. 35 194

[166] Carvalho M, Le Saux B, Trouvé-Peloux P, Almansa A, Champagnat F 2018 Computer Vision–ECCV 2018 Workshops Munich, Germany, September 8–14, 2018 p307

[167] Tian F, Yang W 2022 Opt. Express 30 34479

Google Scholar

Google Scholar

[168] Holsteen A L, Lin D, Kauvar I, Wetzstein G, Brongersma M L 2019 Nano Lett. 19 2267

Google Scholar

Google Scholar

[169] Park M K, Park C S, Hwang Y S, Kim E S, Choi D Y, Lee S S 2020 Adv. Opt. Mater. 8 2000820

Google Scholar

Google Scholar

[170] Harris J L 1964 J. Opt. Soc. Am. 54 931

Google Scholar

Google Scholar

[171] Tsai R, Huang T S 1984 Adv. Comput. Vis. Image Process. 1 317

[172] Chen X, Nakamura T, Pan X X, Tajima K, Yamaguchi K, Shimano T, Yamaguchi M 2021 IEEE International Conference on Image Processing (ICIP) Anchorage, Alaska, USA, September 19–22, 2021 p2808

[173] 张佳琳, 陈钱, 张翔宇, 孙佳嵩, 左超 2019 红外与激光工程 48 603009

Google Scholar

Google Scholar

Zhang J L, Chen Q, Zhang X Y, Sun J S, Zuo C 2019 Infrared Laser Eng. 48 603009

Google Scholar

Google Scholar

[174] Venkataraman K, Lelescu D, Duparre J, McMahon A, Molina G, Chatterjee P, Mullis R, Nayar S 2013 ACM Trans. Graph. 32 166

[175] Zang Z, Wang H, Han Y, Li H, FU H, Luo Y 2021 arXiv: 2106.07872 [physics. optics]

[176] Nakamura T, Kagawa K, Torashima S, Yamaguchi M 2019 Sensors 19 1329

Google Scholar

Google Scholar

[177] Colburn S, Majumdar A 2020 ACS Photonics 7 1529

Google Scholar

Google Scholar

[178] Tech D https://www.163.com/dy/article/FVTTUO5305119734.html [2022-12-11]

-

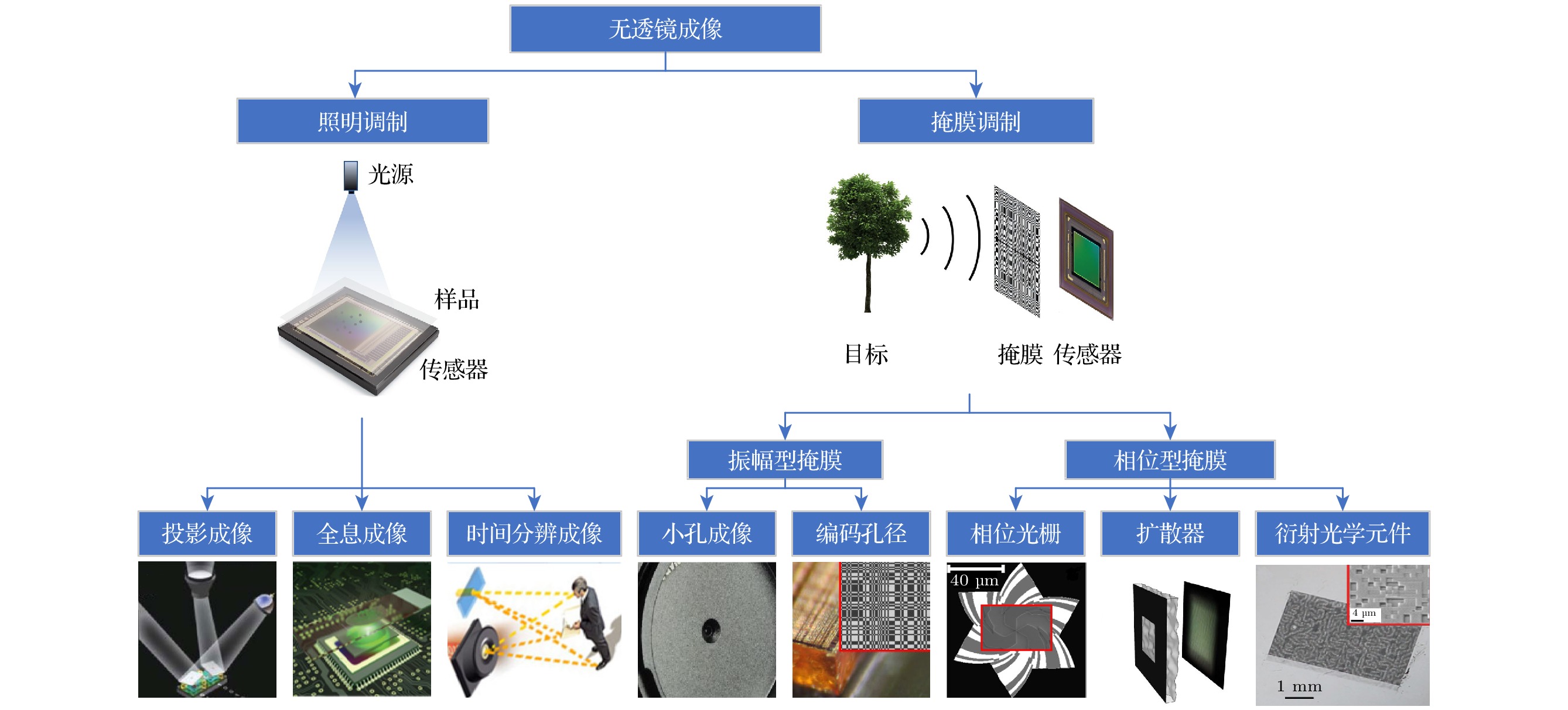

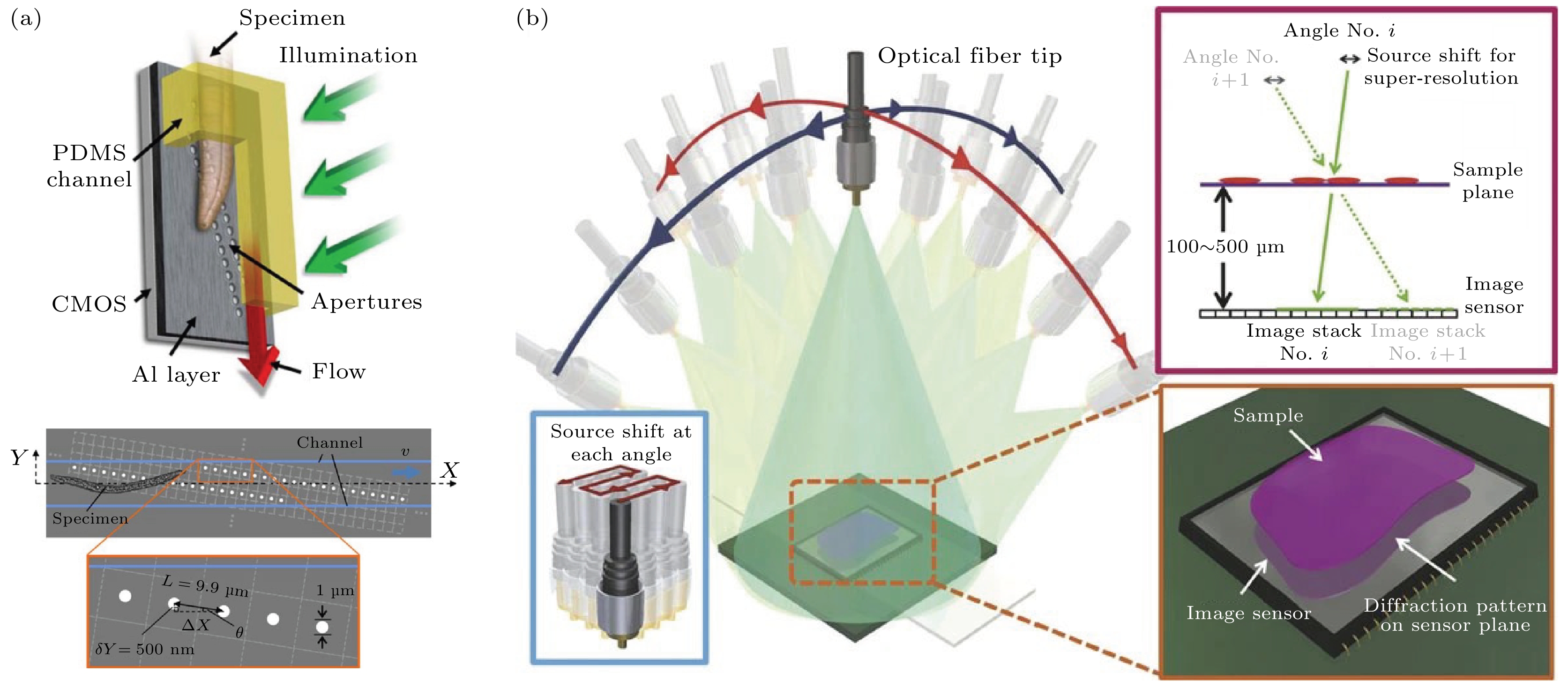

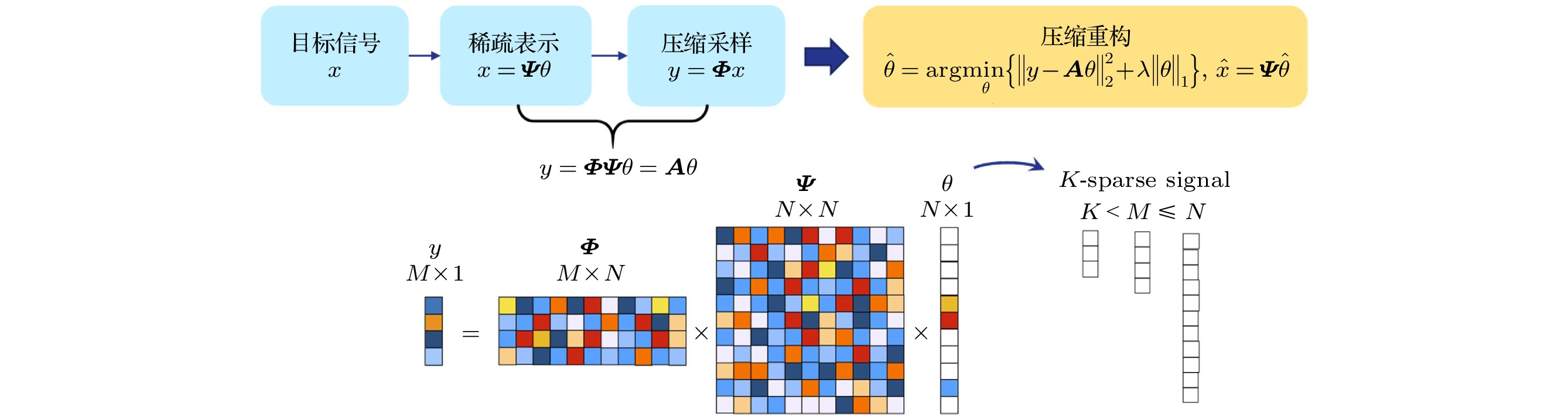

图 7 照明调制 (a)片上光流体显微成像示意图和装置顶视图[57]; (b)基于多角度照明的合成孔径无透镜显微成像装置[60]

Fig. 7. Illumination modulated lensless systems: (a) Schematic diagram of the on-chip optofluidic microscopy and top view of the device[57]; (b) synthetic aperture lensless microscopic imaging device based on multi angle illumination[60].

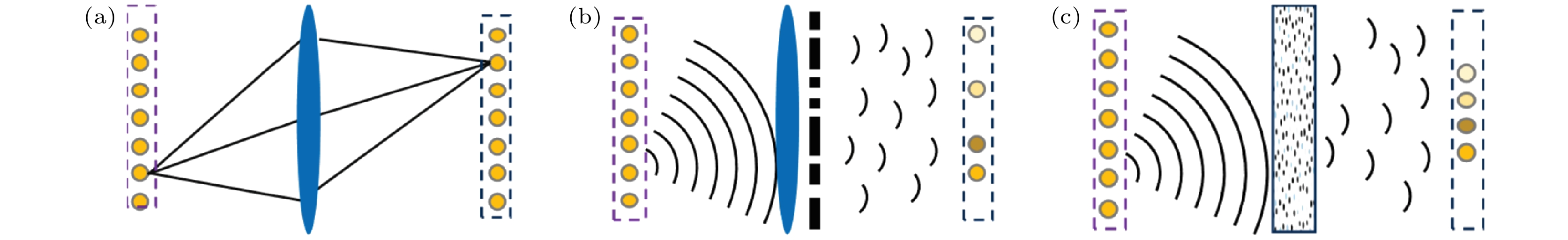

图 8 掩膜调制成像相机的发展历程 2013年Rambus实验室提出相位非对称旋转光栅[77]; 2015年BAE Systems 公司提出可分离Doubly-Toeplitz掩膜[69], Rice大学提出FlatCam[70]; 2017年UC Berkeley提出DiffuserCam[78], 日立公司提出基于菲涅耳孔径的振幅掩膜[73]; 2020年清华大学提出菲涅耳孔径编码[74], UC Berkeley提出用于光谱成像的散射介质相机[79], Rice大学提出基于相位掩膜的PhlatCam[82]; 2021年KAIST提出用于光谱深度成像的DOE[85]; 2022年清华大学提出无透镜复眼微系统[75]

Fig. 8. Development of mask-modulated lensless camera. Rambus lab proposed the phase anti-symmetric spiral gratings[77] in 2013; BAE Systems proposed separable Doubly-Toeplitz masks[69], and Rice University proposed FlatCam[70] in 2015; UC Berkeley proposed DiffuserCam[78] and Hitachi proposed amplitude mask based on Fresnel zone aperture[73] in 2017; Tsinghua University proposed the Fresnel zone aperture[74], UC Berkeley proposed Spectral DiffuserCam[79], and Rice University proposed phase mask based PhlatCam[82] in 2020; KAIST proposed DOE[85] for Hyperspectral-Depth Imaging in 2021; Tsinghua University proposed lensless compound microsystem[75] in 2022.

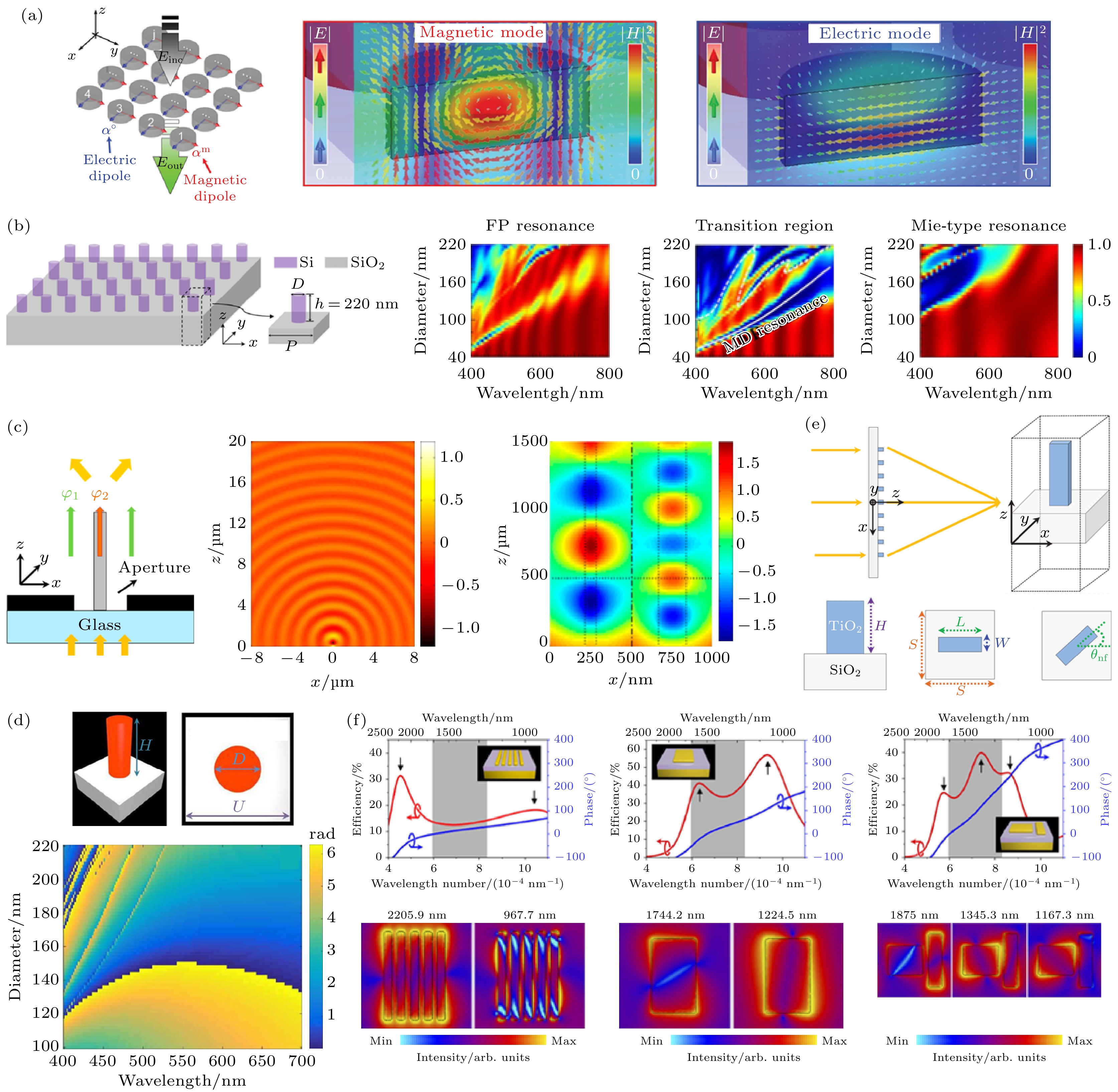

图 10 (a) 惠更斯超构表面以及电偶极子和磁偶极子的电磁场分布[91]; (b) 硅超构表面示意图以及不同周期超构表面的透射强度随硅柱直径和波长的变化[92]; (c) 介质脊波导结构图以及xz面电场分布[93]; (d) 超构透镜结构单元的侧视图和俯视图以及超构表面的模拟相位图[94]; (e) 超构表面单元与几何相位示意图[96]; (f) 基于耦合纳米棒的集成谐振单元的相位分布[97]

Fig. 10. (a) The Huygens’ metasurface as well as the electromagnetic field distribution of electric and magnetic dipoles[91]; (b) schematic of silicon metasurface and the transmission intensity of metasurface depends on the diameter and wavelength of silicon cylinder[92]; (c) schematic diagram of dielectric ridge waveguide and electric field distribution in xz-plane[93]; (d) side-view and top-view of the metasurface building block and simulated phase map for the metasurface[94]; (e) schematic for the metasurface building block and the geometric phase[96]; (f) phase profile of integrated-resonant unit elements based on coupled nano-rods[97].

图 11 超构透镜相机 (a) 薄饼超构透镜相机[100]; (b) 盐粒大小的超构透镜[110]; (c) 超构透镜热成像相机[102]; (d) 近红外超构透镜相机[104]; (e) 长波红外超构透镜相机[107]; (f) 超构透镜阵列集成广角相机[108]

Fig. 11. Metalens cameras: (a) Pancake metalens camera[100]; (b) metalens of salt grain size[110]; (c) metalens thermal imaging camera[102]; (d) near infrared metalens camera[104]; (e) long-wave infrared metalens camera[107]; (f) metalens array integrated wide-angle camera[108]

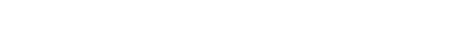

图 16 简单光学成像技术分类. 按照顺时针排列依次为: 深度成像, 例如PhaseCam3D[36], 超构透镜阵列深度传感系统[160]; 高分辨与超分辨成像, 例如端到端优化得到的DOE实现超分辨率成像[156], FlatScope原型样机拍照并计算重建图像[71]; 大景深成像, 例如多级衍射透镜的极深焦距成像[161], 由自旋复用超构透镜阵列实现的光场成像系统[162]; 大视场成像, 例如片上集成μ-CE相机[163], 片上180°×360°圆顶成像系统[164], 超构透镜阵列集成广角相机[108]

Fig. 16. Categories of simple optical imaging techniques. In clockwise order, they are: Depth imaging, e.g., PhaseCam3D[36], the achromatic meta-lens array depth-sensing system[160]; high resolution and super-resolution imaging, e.g., DOE designed by end-to-end optimization for super-resolution[156], imaging by the FlatScope prototype and computational reconstruction of the image[71]; large depth of field imaging, e.g., the multi-level diffractive lens that exhibits extreme-depth-of-focus imaging[161], light-field imaging system enabled by the spin-multiplexed metalens array[162]; wide field-of-view imaging, e.g., the on-chip integrated μ-CE camera[163], the on-chip 180°×360° imaging system[164], metalens array integrated wide-angle camera[108].

表 1 简单透镜成像系统及其实现方法

Table 1. Simple lens imaging system and its implementation.

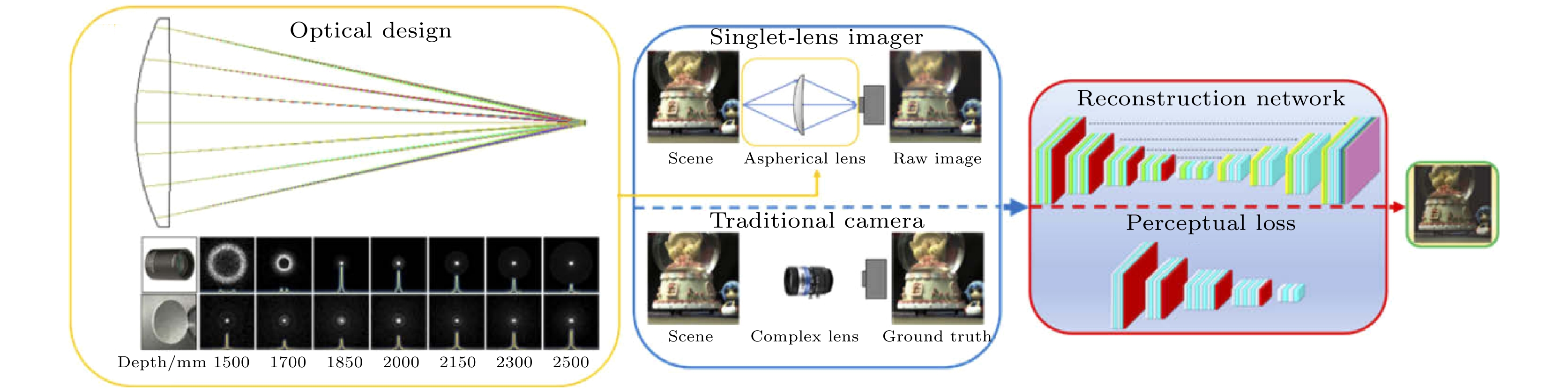

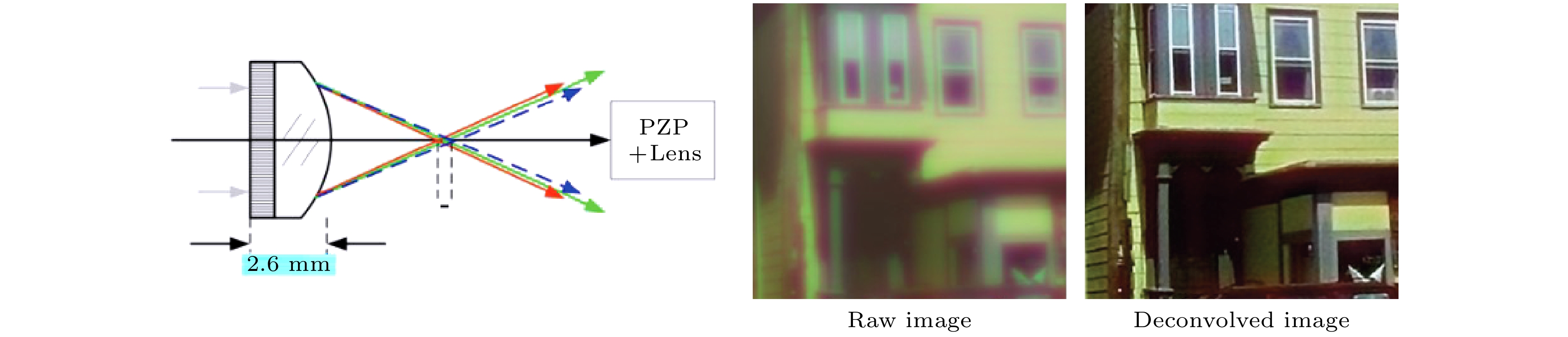

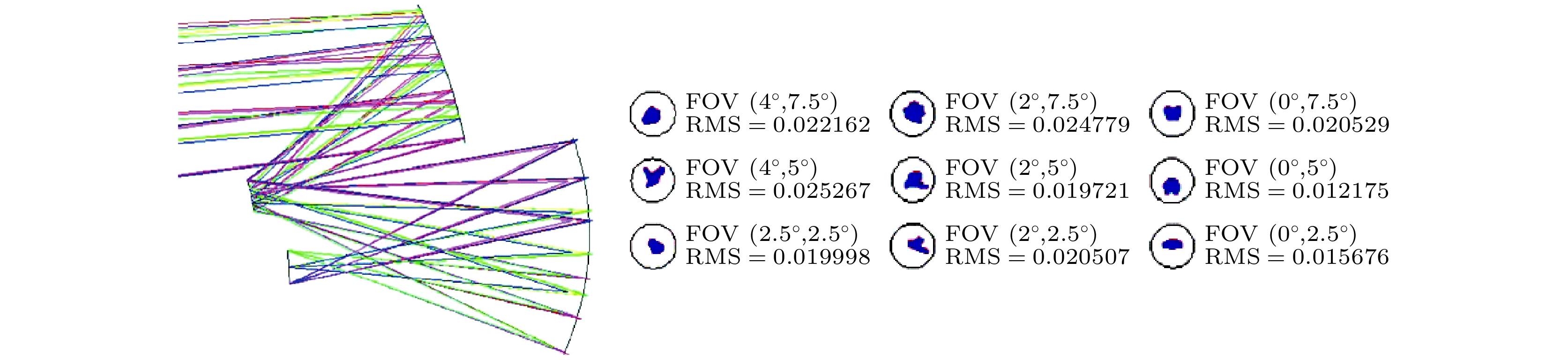

序号 成像元件 方法 作者 1 单透镜 估计单透镜PSF函数, 后利用非盲去卷积算法复原图像 Schuler等[30] 2 单透镜 估计单透镜PSF函数, 再基于交叉通道先验执行非盲去卷积算法复原图像 Heide等[31] 3 单透镜 使用快速可微光线追迹模型和基于Res-Unet的恢复网络实现单镜头端到端设计和高质量成像 Li等[34] 4 折衍混合透镜 由可微分光学层的深度相关PSF对全聚焦图像进行编码, 再利用基于U-Net的深度网络对编码图像进行深度图重构 Wu等[36] 5 折衍混合透镜 设计一款菲涅耳透镜, 通过混合PSF在整个视场上产生空间位移不变的点扩散函数, 建立基于变体U-Net、生成对抗网络和知觉损失的深度学习网络实现高质量图像重建 Peng等[38] 6 透镜组 利用基于噪声图像对的正态Sinh-Arcsinh模型的单镜头相机PSF估计方法, 通过非盲去卷积算法获得高质量图像 Zhan等[41] 7 透镜组 利用一个基于可微分光线追迹渲染引擎的端到端复杂透镜的设计框架对特定成像任务联合优化镜头模块和图像重建网络, 重建网络采用U-Net架构 Sun等[42] 8 透镜组 对简单光学模块引入加权斑块退化模型, 建立DMPH-SE网络实现高质量图像重建 Ji等[44] 表 2 衍射光学元件成像系统

Table 2. Diffractive optical elements imaging system.

序号 工作波长/nm 特点 作者 1 410—690 使用优化方法重新排列PSF的空间和光谱分布, 在硬件上减小色差, 使用交叉尺度先验去卷积重建图像 Peng等[80] 2 400—700 将DOE结构高度编码并使用粒子群算法进行优化, 各 波长模糊核趋于一致, 从而降低去卷积复原的难度 Zhao等[81] 3 Visible

(designed at 532)设计具有轮廓线型PSF的相位掩模, 并使用全变差正则化先验去卷积复原图像, 实现三维成像 Boominathan等[82] 4 420—720 联合优化DOE的高度和图像处理模块的参数, 使用维纳滤波复原图像 Dun等[83] 5 429—699 使用同心环分解的旋转对称衍射消色差设计, 并使用Res-Unet复原图像, 具有高保真成像性能 Dun等[84] 6 420—680 搭建可微分模拟器和神经网络重建方法进行联合优化, 能够实现高光谱深度成像 Baek等[85] 7 Visible

(designed at 550)使用多个DOE堆叠实现变焦, 使用交叉通道先验去卷积复原图像 Heide等[86] 8 875—1675 使用多级衍射透镜实现短波红外成像, 使用维纳滤波去卷积复原图像 Banerji等[87] 表 3 超构透镜相机

Table 3. Metalens cameras.

序号 工作波长/μm 特点 作者 1 0.98 采用单片直径为320 μm的a-Si/SiO2超构透镜, 焦距为800 μm, NA为0.42 Chen等[100] 2 0.4—0.7 采用单片直径为0.5 mm的Si3N4/SiO2超构透镜, 焦距为1 mm, FOV为40° Tseng等[101] 3 9.3—10.6 采用单片直径为12 mm的Si/蓝宝石超构透镜, 焦距为4.48 mm, FOV为178° Zhang等[102] 4 9—12 采用2×3个直径为1.7234 mm的全Si超构透镜, 焦距为1 cm, 将平均串扰降低3倍以上 Zhang等[103] 5 1.55 采用单片直径为2 cm的a-Si/SiO2超构透镜, 焦距为50 mm, NA为0.2 She等[104] 6 0.42—0.65 采用双筒直径为2.6 mm的GaN超构透镜, 焦距为10 mm, 深度测量精度可达50 μm Liu等[105] 7 0.8 采用多个直径为2 mm的a-Si/SiO2超构透镜, 焦距为30 mm, 利用合成孔径实现了与大孔径常规透镜相当的成像分辨率 Zhao等[106] 8 10.6 采用2×2个直径为5 cm的全Si超构透镜阵列, 焦距34 mm, NA为0.592 Hou等[107] 9 0.47 采用1×17个直径为0.3 mm的Si3N4/SiO2超构透镜阵列, 焦距为450 μm, FOV>120° Chen等[108] 10 0.63 采用6×6个直径为0.2 mm的a-Si/Si超构透镜阵列, 焦距为250 μm, NA为0.37 Xu等[109] -

[1] 戴琼海, 索津莉, 季向阳, 曹汛 2016 计算摄像学: 全光视觉信息的计算采集 (北京: 清华大学出版社) 第3—5页

Dai Q H, Suo J L, Ji X Y, Cao X 2016 Computational Photography Computational Capture of Plenoptic Visal Information (Beijing: Tsinghua University Press) pp3–5 (in Chinese)

[2] 薛艳杰, 薛随建, 朱明, 崔辰州 2014 中国科学院院刊 29 368

Xue Y J, Xue S J, Zhu M, Cui C Z 2014 Bull. Chin. Acad. Sci. 29 368

[3] Adkins J https://www.nasa.gov/mission_pages/webb/main/index.html [2023-2-19]

[4] 郭红锋 2022 军事文摘 516 48

Guo H F 2022 Military Digest 516 48

[5] 李焱, 龚旗煌 2015 物理与工程 25 31

Li Y, Gong Q H 2015 Phys. Eng. 25 31

[6] 毛峥乐, 王琛, 程亚 2008 中国激光 35 1283

Google Scholar

Google Scholar

Mao Z L, Wang C, Cheng Y 2008 Chin. J. Lasers 35 1283

Google Scholar

Google Scholar

[7] Kozawa Y, Matsunaga D, Sato S 2018 Optica 5 86

Google Scholar

Google Scholar

[8] 郭乾统, 李博 2021 集成电路应用 9 1

Guo Q T, Li B 2021 Appl. IC 9 1

[9] 杨朝兴 2016 博士学位论文 (上海: 中国科学院上海光学精密机械研究所)

Yang Z X 2016 Ph. D. Dissertation (Shanghai: Shanghai Institute of Optics and Fine Mechanics, the Chinese Academy of Sciences) (in Chinese)

[10] 边丽蘅, 戴琼海 2022 计算成像与感知 (北京: 人民邮电出版社) 第3—5页

Bian L H, Dai Q H 2022 Computational Imaging and Sensing (Beijing: Post & Telecom Press) pp3–5 (in Chinese)

[11] 左超, 陈钱 2022 红外与激光工程 51 20220110

Google Scholar

Google Scholar

Zuo C, Chen Q 2022 Infrared Laser Eng. 51 20220110

Google Scholar

Google Scholar

[12] 杨彦杰 2017 红外 38 8

Yang Y J 2017 Infrared 38 8

[13] Shi F https://www.163.com/dy/article/GNI2FICD0511PT5V.html [2022-12-5]

[14] Wright E https://svs.gsfc.nasa.gov/4720 [2022-12-5]

[15] Doshi S https://seas.harvard.edu/news/2021/03/federico-capasso-help-develop-super-camera [2022-12-5]

[16] Wu J, Guo Y, Deng C, Zhang A, Qiao H, Lu Z, Xie J, Fang L, Dai Q H 2022 Nature 612 62

Google Scholar

Google Scholar

[17] Authier A 2003 Dynamical Theory of X-Ray Diffraction (London: Oxford University Press) pp479-480

[18] 陈宜方 2022 光学学报 42 1134005

Google Scholar

Google Scholar

Chen Y F 2022 Acta Opt. Sin. 42 1134005

Google Scholar

Google Scholar

[19] Chao W, Kim J, Rekawa S, Fischer P, Anderson E H 2009 Opt. Express 17 17669

Google Scholar

Google Scholar

[20] Mohacsi I, Vartiainen I, Rosner B, Guizar-Sicairos M, Guzenko V A, McNulty I, Winarski R, Holt M V, David C 2017 Sci. Rep. 7 43624

Google Scholar

Google Scholar

[21] 孙世峰 2020 物理学报 69 198701

Google Scholar

Google Scholar

Sun S F 2020 Acta Phys. Sin. 69 198701

Google Scholar

Google Scholar

[22] Dicke R 1968 Astrophys. J. 153 L101

Google Scholar

Google Scholar

[23] Ables J 1968 Publ. Astron. Soc. Pac. 1 172

Google Scholar

Google Scholar

[24] Haboub A, MacDowell A A, Marchesini S, Parkinson D Y 2014 Rev. Sci. Instrum. 85 063704

Google Scholar

Google Scholar

[25] Kulow A, Buzanich A G, Reinholz U, Streli C, Radtke M 2020 J. Anal. At. Spectrom. 35 347

Google Scholar

Google Scholar

[26] Glovinski C https://www.metalenz.com/press-release-metalenz-raises-30-million-series-b-led-by-neotribe-ventures-to-address-fast-growing-demand-for-its-breakthrough-metasurface-optics/ [2022-12-5]

[27] Yang X https://36kr.com/p/1673109498994694?channel=wechat [2022-12-6]

[28] Schneider J https://petapixel.com/2021/07/12/samsung-researching-flat-metalens-tech-for-smartphone-integration/ [2022-12-5]

[29] https://www.nsfc.gov.cn/publish/portal0/tab1392/info87786.htm [2022-12-8]

[30] Schuler C J, Hirsch M, Harmeling S, Schölkopf B 2011 International Conference on Computer Vision Barcelona, Spain, November 6–13, 2011 p659

[31] Heide F, Rouf M, Hullin M B, Labitzke B, Heidrich W, Kolb A 2013 ACM Trans. Graph. 32 149

[32] Bian Y X, Jiang Y N, Huang Y R, Yang X F, Deng W J, Shen H, Shen R B, Kuang C F 2021 Opt. Laser Technol. 139 106900

Google Scholar

Google Scholar

[33] Liu Y, Zhang C, Kou T, Li Y, Shen J 2021 Opt. Express 29 28530

Google Scholar

Google Scholar

[34] Li Z, Hou Q, Wang Z, Tan F, Liu J, Zhang W 2021 Opt. Lett. 46 5453

Google Scholar

Google Scholar

[35] Peng Y, Fu Q, Amata H, Su S, Heide F, Heidrich W 2015 Opt. Express 23 31393

Google Scholar

Google Scholar

[36] Wu Y, Boominathan V, Chen H, Sankaranarayanan A, Veeraraghavan A 2019 IEEE International Conference on Computational Photography (ICCP) Tokyo, Japan, May 15–17, 2019 p1

[37] Chang J, Wetzstein G 2019 IEEE/CVF International Conference on Computer Vision (ICCV) Seoul, Korea (South), October 27–November 2, 2019 p10192

[38] Peng Y F, Sun Q L, Dun X, Wetzstein G, Heidrich W, Heide F 2019 ACM Trans. Graph. 38 1

[39] Qi B, Chen W, Dun X, Hao X, Wang R, Liu X, Li H, Peng Y 2022 Appl. Opt. 61 1097

Google Scholar

Google Scholar

[40] 郑云达, 黄玮, 徐明飞, 潘云, 贾树强, 张晓菲, 卢勇男 2019 中国光学 12 1090

Google Scholar

Google Scholar

Zheng Y D, Huang W, Xu M F, Pan Y, Jia S Q, Zhang X F, Lu Y N 2019 Chin. Opt. 12 1090

Google Scholar

Google Scholar

[41] Zhan D Z, Li W L, Yin X Q, Niu C Y, Liu J 2021 IEEE Access 9 49338

Google Scholar

Google Scholar

[42] Sun Q, Wang C, Fu Q, Dun X, Heidrich W 2021 ACM Trans. Graph. 40 1

[43] Tseng E, Mosleh A, Mannan F, St-Arnaud K, Sharma A, Peng Y F, Braun A, Nowrouzezahrai D, Lalonde J F, Heide F 2021 ACM Trans. Graph. 40 18

[44] Ji J R, Xie H B, Yang L 2023 Opt. Commun. 526 128918

Google Scholar

Google Scholar

[45] 程颖 2013 博士学位论文 (天津: 天津大学)

Cheng Y 2013 Ph. D. Dissertation (Tianjin: Tianjin University) (in Chinese)

[46] Beier M, Hartung J, Peschel T, Damm C, Gebhardt A, Scheiding S, Stumpf D, Zeitner U D, Risse S, Eberhardt R, Tunnermann A 2015 Appl. Opt. 54 3530

Google Scholar

Google Scholar

[47] 陈炳旭, 廖志远, 操超, 白瑜, 牟达 2020 红外与激光工程 49 20200005

Google Scholar

Google Scholar

Chen B X, Liao Z Y, Cao C, Bai Y, Mu D 2020 Infrared Laser Eng. 49 20200005

Google Scholar

Google Scholar

[48] Yu J, Wang Y F, Qiu R S, Wang Z S 2022 Infrared Phys. Technol. 123 104207

Google Scholar

Google Scholar

[49] Meng Q, Wang H, Liang W, Yan Z, Wang B 2019 Appl. Opt. 58 609

Google Scholar

Google Scholar

[50] Ni J, Yang T, Cheng D, Wang Y 2021 Appl. Opt. 60 4491

Google Scholar

Google Scholar

[51] Zhang B, Jin G, Zhu J 2021 Light Sci. Appl. 10 65

Google Scholar

Google Scholar

[52] 杨通, 段璎哲, 程德文, 王涌天 2021 光学学报 41 0108001

Google Scholar

Google Scholar

Yang T, Duan Y Z, Cheng D W, Wang Y T 2021 Acta Opt. Sin. 41 0108001

Google Scholar

Google Scholar

[53] 吴佳琛 2022 博士学位论文 (北京: 清华大学)

Wu J C 2022 Ph. D. Dissertation (Beijing: Tsinghua University) (in Chinese)

[54] Lange D, Storment C W, Conley C A, Kovacs G T A 2005 Sens. Actuators B Chem. 107 904

Google Scholar

Google Scholar

[55] Ozcan A, McLeod E 2016 Annu. Rev. Biomed. Eng. 18 77

Google Scholar

Google Scholar

[56] Ozcan A, Demirci U 2008 Lab Chip 8 98

Google Scholar

Google Scholar

[57] Cui X, Lee L M, Heng X, Zhong W, Sternberg P W, Psaltis D, Yang C 2008 Proc. Natl. Acad. Sci. U. S. A. 105 10670

Google Scholar

Google Scholar

[58] Zheng G, Lee S A, Yang S, Yang C 2010 Lab Chip 10 3125

Google Scholar

Google Scholar

[59] Gabor D 1948 Nature 161 777

Google Scholar

Google Scholar

[60] Luo W, Greenbaum A, Zhang Y B, Ozcan A 2015 Light Sci. Appl. 4 e261

Google Scholar

Google Scholar

[61] Kirmani A, Jeelani H, Montazerhodjat V, Goyal V K 2012 IEEE Signal. Process. Lett. 19 31

Google Scholar

Google Scholar

[62] Wu D, Wetzstein G, Barsi C, Willwacher T, Dai Q H, Raskar R 2014 Int. J. Comput. Vis. 110 128

Google Scholar

Google Scholar

[63] Satat G, Tancik M, Raskar R 2017 IEEE Trans. Comput. Imaging 3 398

Google Scholar

Google Scholar

[64] Rego J D, Chen H, Li S, Gu J, Jayasuriya S 2022 Opt. Express 30 27214

Google Scholar

Google Scholar

[65] Barrett H H, Horrigan F A 1973 Appl. Opt. 12 2686

Google Scholar

Google Scholar

[66] Anand V, Katkus T, Linklater D P, Ivanova E P, Juodkazis S 2020 J. Imaging 6 99

[67] Fenimore E E, Cannon T M 1978 Appl. Opt. 17 337

Google Scholar

Google Scholar

[68] Gottesman S R, Fenimore E E 1989 Appl. Opt. 28 4344

Google Scholar

Google Scholar

[69] DeWeert M J, Farm B P 2015 Opt. Eng. 54 023102

Google Scholar

Google Scholar

[70] Asif M S, Ayremlou A, Sankaranarayanan A, Veeraraghavan A, Baraniuk R G 2017 IEEE Trans. Comput. Imaging 3 384

Google Scholar

Google Scholar

[71] Adams J K, Boominathan V, Avants B W, Vercosa D G, Ye F, Baraniuk R G, Robinson J T, Veeraraghavan A 2017 Sci. Adv. 3 e1701548

Google Scholar

Google Scholar

[72] Shimano T, Nakamura Y, Tajima K, Sao M, Hoshizawa T 2018 Appl. Opt. 57 2841

Google Scholar

Google Scholar

[73] Tajima K, Shimano T, Nakamura Y, Sao M, Hoshizawa T 2017 IEEE International Conference on Computational Photography (ICCP) Stanford Univ, Stanford, CA, May. 12-14, 2017 p1

[74] Wu J, Zhang H, Zhang W, Jin G, Cao L, Barbastathis G 2020 Light Sci. Appl. 9 53

[75] Zhang L, Zhan H, Liu X, Xing F, You Z 2022 Microsyst. Nanoeng. 8 83

Google Scholar

Google Scholar

[76] Stork D G, Gill P R 2013 The Seventh International Conference on Sensor Technologies and Applications Barcelona, Spain, Auguest 25–31, 2013 p186

[77] Stork D G, Gill P R 2014 Int. J. Adv. Syst. Meas. 7 201

[78] Antipa N, Kuo G, Heckel R, Mildenhall B, Bostan E, Ng R, Waller L 2018 Optica 5 1

Google Scholar

Google Scholar

[79] Monakhova K, Yanny K, Aggarwal N, Waller L 2020 Optica 7 1298

Google Scholar

Google Scholar

[80] Peng Y F, Fu Q, Heide F, Heidrich W 2016 ACM Trans. Graph. 35 31

[81] 赵玺竣, 范斌, 何一苇, 张豪, 郑书培, 钟烁, 雷嘉明, 杨伟, 杨虎 2022 光学学报 42 1305001

Google Scholar

Google Scholar

Zhao X J, Fan B, He Y W, Zhang H, Zheng S P, Zhong S, Lei J M, Yang W, Yang H 2022 Acta Opt. Sin. 42 1305001

Google Scholar

Google Scholar

[82] Boominathan V, Adams J K, Robinson J T, Veeraraghavan A 2020 IEEE Trans. Pattern Anal. Mach. Intell. 42 1618

Google Scholar

Google Scholar

[83] Dun X, Ikoma H, Wetzstein G, Wang Z S, Cheng X B, Peng Y F 2020 Optica 7 913

Google Scholar

Google Scholar

[84] Dun X, Wang Z S, Peng Y F 2019 SPIE/COS Photonics Asia Hangzhou, China, October 20–23, 2020 p111870 I

[85] Baek S-H, Ikoma H, Jeon D S, Li Y Q, Heidrich W, Wetzstein G, Kim M H 2021 IEEE/CVF International Conference on Computer Vision (ICCV) Montreal, QC, Canada, October 10–17, 2021 p2631

[86] Heide F, Fu Q, Peng Y, Heidrich W 2016 Sci. Rep. 6 33543

Google Scholar

Google Scholar

[87] Banerji S, Meem M, Majumder A, Dvonch C, Sensale-Rodriguez B, Menon R 2019 Osa Continuum 2 2968

Google Scholar

Google Scholar

[88] Chen W T, Zhu A D Y, Capasso F 2020 Nat. Rev. Mater. 5 604

Google Scholar

Google Scholar

[89] Zou X J, Zheng G G, Yuan Q, Zang W B, Chen R, Li T Y, Li L, Wang S M, Wang Z L, Zhu S N 2020 Photonix 1 2

Google Scholar

Google Scholar

[90] Pan M, Fu Y, Zheng M, Chen H, Zang Y, Duan H, Li Q, Qiu M, Hu Y 2022 Light Sci. Appl. 11 195

Google Scholar

Google Scholar

[91] Decker M, Staude I, Falkner M, Dominguez J, Neshev D N, Brener I, Pertsch T, Kivshar Y S 2015 Adv. Opt. Mater. 3 813

Google Scholar

Google Scholar

[92] Li J, Wu T, Xu W, Liu Y, Liu C, Wang Y, Yu Z, Zhu D, Yu L, Ye H 2019 Opt. Express 27 23186

Google Scholar

Google Scholar

[93] Khorasaninejad M, Capasso F 2015 Nano Lett. 15 6709

Google Scholar

Google Scholar

[94] Khorasaninejad M, Zhu A Y, Roques-Carmes C, Chen W T, Oh J, Mishra I, Devlin R C, Capasso F 2016 Nano Lett. 16 7229

Google Scholar

Google Scholar

[95] 张飞, 蔡吉祥, 蒲明博, 罗先刚 2021 物理 50 300

Google Scholar

Google Scholar

Zhang F, Cai J X, Pu M B, Luo X G 2021 Physics 50 300

Google Scholar

Google Scholar

[96] Khorasaninejad M, Chen W T, Devlin R C, Oh J, Zhu A Y, Capasso F 2016 Science 352 1190

Google Scholar

Google Scholar

[97] Wang S, Wu P C, Su V C, Lai Y C, Hung Chu C, Chen J W, Lu S H, Chen J, Xu B, Kuan C H, Li T, Zhu S, Tsai D P 2017 Nat. Commun. 8 187

Google Scholar

Google Scholar

[98] Berry M V 1984 Proc. R. Soc. Lond. A 392 45

[99] Pancharatnam S 2013 Resonance 18 387

Google Scholar

Google Scholar

[100] Chen C, Ye X, Sun J, Chen Y, Huang C, Xiao X, Song W, Zhu S, Li T 2022 Optica 9 1314

Google Scholar

Google Scholar

[101] Tseng E, Colburn S, Whitehead J, Huang L, Baek S H, Majumdar A, Heide F 2021 Nat. Commun. 12 6493

Google Scholar

Google Scholar

[102] Zhang F, Pu M, Li X, Ma X, Guo Y, Gao P, Yu H, Gu M, Luo X 2021 Adv. Mater. 33 e2008157

Google Scholar

Google Scholar

[103] Zhang Y X, Pu M B, Jin J J, Lu X J, Guo Y H, Cai J X, Zhang F, Ha Y L, He Q, Xu M F, Li X, Ma X L, Luo X G 2022 Opto-Electron. Adv. 5 220058

Google Scholar

Google Scholar

[104] She A, Zhang S, Shian S, Clarke D R, Capasso F 2018 Opt. Express 26 1573

Google Scholar

Google Scholar

[105] Liu X, Chen M K, Chu C H, Zhang J, Leng B, Yamaguchi T, Tanaka T, Tsai D P 2023 ACS Photonics 2 c01667

[106] Zhao F, Shen Z C, Wang D C, Xu B J, Chen X N, Yang Y M 2021 Photonics Res. 9 2388

Google Scholar

Google Scholar

[107] Hou M M, Chen Y, Yi F 2022 Conference on Lasers and Electro-Optics (CLEO) San Jose, CA, USA, May 15-20, 2022 p1

[108] Chen J, Ye X, Gao S L, Chen Y X, Zhao Y W, Huang C Y, Qiu K, Zhu S N, Li T 2022 Optica 9 431

Google Scholar

Google Scholar

[109] Xu B B, Li H M, Gao S L, Hua X, Yang C, Chen C, Yan F, Zhu S N, Li T 2020 Adv. Photonics 2 066004

[110] Tseng E, Colburn S, Whitehead J, Huang L, Baek S H, Majumdar A, Heide F https://light.princeton.edu/publication/neural-nano-optics/ [2022-12-12]

[111] Colburn S, Zhan A, Majumdar A 2018 Sci. Adv. 4 eaar2114

Google Scholar

Google Scholar

[112] Lei Y S, Guo Y H, Pu M B, He Q, Gao P, Li X, Ma X L, Luo X G 2022 Phys. Status. Solidi-Rapid Res. Lett. 16 2100469

Google Scholar

Google Scholar

[113] Anand V, Han M, Maksimovic J, Ng S H, Katkus T, Klein A, Bambery K, Tobin M J, Vongsvivut J, Juodkazis S 2022 Opto-Electron. Sci. 1 210006

Google Scholar

Google Scholar

[114] 赵丽萍, 邬敏贤, 金国藩, 严瑛白 1998 光学学报 18 621

Google Scholar

Google Scholar

Zhao L P, Wu M X, Jin G F, Yan Y B 1998 Acta Opt. Sin. 18 621

Google Scholar

Google Scholar

[115] Boominathan V, Robinson J T, Waller L, Veeraraghavan A 2022 Optica 9 1

Google Scholar

Google Scholar

[116] 李雄, 马晓亮, 罗先刚 2017 光电工程 44 255

Google Scholar

Google Scholar

Li X, Ma X L, Luo X G 2017 Opto-Electron. Rev. 44 255

Google Scholar

Google Scholar

[117] 许可, 王星儿, 范旭浩, 刘耘呈, 余轩, 高辉, 熊伟 2022 光电工程 49 220183

Google Scholar

Google Scholar

Xu K, Wang X E, Fan X H, Liu Y C, Yu X, Gao H, Xiong W 2022 Opto-electron. Rev. 49 220183

Google Scholar

Google Scholar

[118] 蔡利梅 2020MATLAB图像处理: 理论、算法与实例分析 (北京: 清华大学出版社) 第274—298页

Cai L M 2022 MATLAB Image Processing Theory Algorithm and Case Analysis (Beijing: Tsinghua University Press) pp274–298 (in Chinese)

[119] 张华 2020 博士学位论文 (北京: 清华大学)

Zhang H 2020 Ph. D. Dissertation (Beijing: Tsinghua University) (in Chinese)

[120] Farsiu S, Robinson M D, Elad M, Milanfar P 2004 IEEE Trans. Image. Process. 13 1327

Google Scholar

Google Scholar

[121] Bredies K, Kunisch K, Pock T 2010 SIAM J. Imaging Sci. 3 492

Google Scholar

Google Scholar

[122] Daubechies I, Defrise M, De Mol C 2004 Commun. Pure Appl. Math. 57 1413

Google Scholar

Google Scholar

[123] Bioucas-Dias J M, Figueiredo M A 2007 IEEE Trans. Image. Process. 16 2992

Google Scholar

Google Scholar

[124] Beck A, Teboulle M 2009 SIAM J. Imaging Sci. 2 183

Google Scholar

Google Scholar

[125] Boyd S, Parikh N, Chu E, Peleato B, Eckstein J 2011 Found. Trends Mach. Learn. 3 1

Google Scholar

Google Scholar

[126] Wu J C, Cao L C 2022 Acta Photon. Sin. 51 0751412

Google Scholar

Google Scholar

[127] Choi K, Horisaki R, Hahn J, Lim S, Marks D L, Schulz T J, Brady D J 2010 Appl. Opt. 49 H1

Google Scholar

Google Scholar

[128] Cull C F, Wikner D A, Mait J N, Mattheiss M, Brady D J 2010 Appl. Opt. 49 E67

Google Scholar

Google Scholar

[129] Hahn J, Lim S, Choi K, Horisaki R, Brady D J 2011 Opt. Express 19 7289

Google Scholar

Google Scholar

[130] Hahn J, Lim S, Choi K, Horisaki R, Marks D L, Brady D J 2010 Biomedical Optics and 3-D Imaging Miami Florida, April 11–14, 2010 pJMA1

[131] Zhang H, Cao L C, Jin G F, Brady D 2020 Laser Optoelectron. Prog. 57 080001

[132] Ma C G, Cao X, Tong X, Dai Q H, Lin S 2014 Int. J. Comput. Vis. 110 141

Google Scholar

Google Scholar

[133] Zuo C, Sun J, Zhang J, Hu Y, Chen Q 2015 Opt. Express 23 14314

Google Scholar

Google Scholar

[134] Wang H, Lyu M, Situ G 2018 Opt. Express 26 22603

Google Scholar

Google Scholar

[135] Wang K, Dou J, Kemao Q, Di J, Zhao J 2019 Opt. Lett. 44 4765

Google Scholar

Google Scholar

[136] Ren Z B, Xu Z M, Lam E Y 2019 Adv. Photonics 1 016004

[137] Tahara T, Zhang Y P, Rosen J, Anand V, Cao L C, Wu J C, Koujin T, Matsuda A, Ishii A, Kozawa Y, Okamoto R, Oi R, Nobukawa T, Choi K, Imbe M, Poon T C 2022 Appl. Phys. B Lasers Opt. 128 193

Google Scholar

Google Scholar

[138] Wu Y F, Wu J C, Jin S Z, Cao L C, Jin G F 2021 Opt. Commun. 493 126970

Google Scholar

Google Scholar

[139] Bai C, Zhou M, Min J, Dang S, Yu X, Zhang P, Peng T, Yao B 2019 Opt. Lett. 44 5141

Google Scholar

Google Scholar

[140] Wang F, Bian Y, Wang H, Lyu M, Pedrini G, Osten W, Barbastathis G, Situ G 2020 Light Sci. Appl. 9 77

Google Scholar

Google Scholar

[141] Metzler C, Schniter P, Veeraraghavan A, Baraniuk R 2018 Proceedings of the 35th International Conference on Machine Learning Stockholmsmässan Stockholm, Sweden, July 10–15, 2018 p3501

[142] Li S, Deng M, Lee J, Sinha A, Barbastathis G 2018 Optica 5 803

Google Scholar

Google Scholar

[143] Li Y Z, Xue Y J, Tian L 2018 Optica 5 1181

Google Scholar

Google Scholar

[144] Alom M Z, Taha T M, Yakopcic C, Westberg S, Sidike P, Nasrin M S, Hasan M, Van Essen B C, Awwal A A S, Asari V K 2019 Electronics 8 292

Google Scholar

Google Scholar

[145] Barbastathis G, Ozcan A, Situ G 2019 Optica 6 921

Google Scholar

Google Scholar

[146] He K, Zhang X, Ren S, Sun J 2015 IEEE International Conference on Computer Vision (ICCV) Santiago Chile, December 7–13, 2015 p1026

[147] Lecun Y, Bottou L, Bengio Y, Haffner P 1998 Proc. IEEE 86 2278

Google Scholar

Google Scholar

[148] Lipton Z C, Berkowitz J, Elkan C 2015 arXiv: 1506.00019 [cs. LG]

[149] 王飞, 王昊, 卞耀明, 司徒国海 2020 光学学报 40 0111002

Google Scholar

Google Scholar

Wang F, Wang H, Bian Y M, Situ G H 2020 Acta Opt. Sin. 40 0111002

Google Scholar

Google Scholar

[150] Ronneberger O, Fischer P, Brox T 2015 Medical Image Computing and Computer-Assisted Intervention–MICCAI Munich, Germany, October 5–9, 2015 p234

[151] Khan S S, Adarsh V, Boominathan V, Tan J, Veeraraghavan A, Mitra K 2019 IEEE/CVF International Conference on Computer Vision (ICCV) Seoul, Korea (South), October 27–November 2, 2019 p7859

[152] Wu J, Cao L, Barbastathis G 2021 Opt. Lett. 46 130

Google Scholar

Google Scholar

[153] Haris M, Shakhnarovich G, Ukita N 2018 IEEE/CVF Conference on Computer Vision and Pattern Recognition Salt Lake City, UT, USA, June 18–23, 2018 p1664

[154] Zhou H, Feng H J, Hu Z X, Xu Z H, Li Q, Chen Y T 2020 Opt. Express 28 30248

Google Scholar

Google Scholar

[155] 李江勇, 吴晓琴, 刘飞, 魏雅喆, 邵晓鹏 2021 光学学报 41 2422004

Google Scholar

Google Scholar

Li J Y, Wu X Q, Liu F, Wei Y Z, Shao X P 2021 Acta Opt. Sin. 41 2422004

Google Scholar

Google Scholar

[156] Sitzmann V, Diamond S, Peng Y F, Dun X, Boyd S, Heidrich W, Heide F, Wetzstein G 2018 ACM Trans. Graph. 37 114

[157] Liu X, Li L, Liu X, Hao X, Peng Y 2022 Opt. Express 30 36973

Google Scholar

Google Scholar

[158] Stork D G, Robinson M D 2008 Appl. Opt. 47 B64

Google Scholar

Google Scholar

[159] Robinson M D, Stork D 2008 Optical Systems Design Glasgow, Scotland, United Kingdom, September 27, 2008 p710011

[160] Chen M K, Liu X, Wu Y, Zhang J, Yuan J, Zhang Z, Tsai D P 2022 Adv. Mater. e2107465

[161] Banerji S, Meem M, Majumder A, Sensale-Rodriguez B, Menon R 2020 Optica 7 214

Google Scholar

Google Scholar

[162] Fan Q, Xu W, Hu X, Zhu W, Yue T, Zhang C, Yan F, Chen L, Lezec H J, Lu Y, Agrawal A, Xu T 2022 Nat. Commun. 13 2130

Google Scholar

Google Scholar

[163] Hu Z Y, Zhang Y L, Pan C, Dou J Y, Li Z Z, Tian Z N, Mao J W, Chen Q D, Sun H B 2022 Nat. Commun. 13 5634

Google Scholar

Google Scholar

[164] Toulouse A, Drozella J, Motzfeld P, Fahrbach N, Aslani V, Thiele S, Giessen H, Herkommer A M 2022 Opt. Express 30 707

Google Scholar

Google Scholar

[165] Baek S H, Gutierrez D, Kim M H 2016 ACM Trans. Graph. 35 194

[166] Carvalho M, Le Saux B, Trouvé-Peloux P, Almansa A, Champagnat F 2018 Computer Vision–ECCV 2018 Workshops Munich, Germany, September 8–14, 2018 p307

[167] Tian F, Yang W 2022 Opt. Express 30 34479

Google Scholar

Google Scholar

[168] Holsteen A L, Lin D, Kauvar I, Wetzstein G, Brongersma M L 2019 Nano Lett. 19 2267

Google Scholar

Google Scholar

[169] Park M K, Park C S, Hwang Y S, Kim E S, Choi D Y, Lee S S 2020 Adv. Opt. Mater. 8 2000820

Google Scholar

Google Scholar

[170] Harris J L 1964 J. Opt. Soc. Am. 54 931

Google Scholar

Google Scholar

[171] Tsai R, Huang T S 1984 Adv. Comput. Vis. Image Process. 1 317

[172] Chen X, Nakamura T, Pan X X, Tajima K, Yamaguchi K, Shimano T, Yamaguchi M 2021 IEEE International Conference on Image Processing (ICIP) Anchorage, Alaska, USA, September 19–22, 2021 p2808

[173] 张佳琳, 陈钱, 张翔宇, 孙佳嵩, 左超 2019 红外与激光工程 48 603009

Google Scholar

Google Scholar

Zhang J L, Chen Q, Zhang X Y, Sun J S, Zuo C 2019 Infrared Laser Eng. 48 603009

Google Scholar

Google Scholar

[174] Venkataraman K, Lelescu D, Duparre J, McMahon A, Molina G, Chatterjee P, Mullis R, Nayar S 2013 ACM Trans. Graph. 32 166

[175] Zang Z, Wang H, Han Y, Li H, FU H, Luo Y 2021 arXiv: 2106.07872 [physics. optics]

[176] Nakamura T, Kagawa K, Torashima S, Yamaguchi M 2019 Sensors 19 1329

Google Scholar

Google Scholar

[177] Colburn S, Majumdar A 2020 ACS Photonics 7 1529

Google Scholar

Google Scholar

[178] Tech D https://www.163.com/dy/article/FVTTUO5305119734.html [2022-12-11]

计量

- 文章访问数: 46520

- PDF下载量: 1005

- 被引次数: 0

下载:

下载: